La rentabilité de l’IA industrielle ne se mesure pas au coût de développement, mais au « Coût de l’Inflexibilité » (COI) qu’elle élimine par rapport au code rigide.

- La programmation `IF-THEN` est un actif qui se déprécie, créant une dette technique coûteuse face à chaque imprévu ou nouvelle variation de production.

- Le Machine Learning est un système adaptatif dont la valeur augmente avec la complexité et la variabilité, transformant les exceptions en opportunités d’apprentissage.

Recommandation : Cessez de comparer les budgets de développement initiaux. Évaluez la rentabilité sur 3 ans en intégrant le coût des futures adaptations, des arrêts de ligne et des opportunités manquées dues à la rigidité du code.

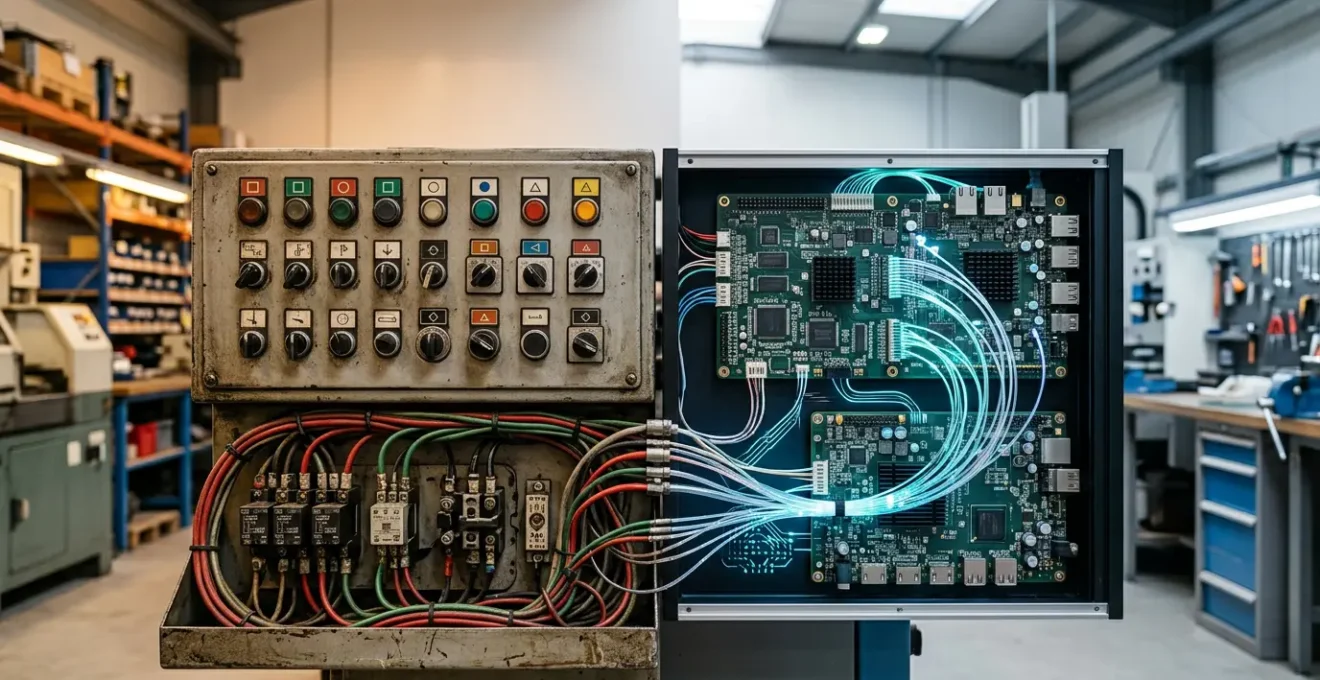

En tant que DSI industriel, un scénario vous est familier. Une nouvelle référence produit, une légère variation de la matière première, un défaut de surface jamais vu auparavant, et la demande atterrit sur votre bureau : « Il faut modifier le programme de contrôle qualité ». Chaque instruction `IF-THEN-ELSE` de votre parc applicatif est un engagement sur la fixité du monde. Une promesse que rien ne changera. Or, l’usine, elle, change en permanence.

La tentation est de voir le Machine Learning (ML) comme une solution complexe, une « boîte noire » coûteuse réservée aux géants du numérique. On parle de Big Data, de serveurs de calcul, et le budget semble vite hors de contrôle par rapport à une simple mise à jour de code. Cette vision, bien que compréhensible, passe à côté de l’essentiel et fausse complètement l’analyse de rentabilité. Le véritable arbitrage ne se situe pas sur le coût de développement initial, mais sur un passif caché dans votre existant : le Coût de l’Inflexibilité (COI).

Cet article n’est pas un cours de data science. C’est une analyse ROIste conçue pour vous, DSI, afin de vous donner les clés pour arbitrer entre la certitude rigide d’un script et le potentiel adaptatif d’un modèle d’IA. Nous allons déconstruire le calcul du ROI en y intégrant cette notion de flexibilité, pour vous permettre de justifier un investissement en IA non pas comme un coût technologique, mais comme une assurance stratégique contre l’imprévu et un levier de performance durable.

Cet article est structuré pour vous guider, des fondations techniques jusqu’aux implications stratégiques et financières. Le sommaire ci-dessous vous permettra de naviguer à travers les points clés de cette analyse comparative.

Sommaire : Comprendre l’arbitrage financier entre IA et programmation rigide

- Pourquoi vos modèles d’IA échouent : le problème des données « sales » issues des vieux automates

- Défauts inconnus : pourquoi l’apprentissage non-supervisé est le seul choix pour la détection d’anomalies rares ?

- Du labo à l’usine : comment mettre à jour un modèle IA en production sans arrêter la ligne ?

- Boîte noire : comment expliquer à l’opérateur pourquoi l’IA a rejeté une pièce apparemment bonne ?

- TinyML : faire tourner une IA sur un microcontrôleur à 5€, est-ce possible ?

- Comment calculer votre ROI robotique sur 3 ans sans oublier les coûts cachés ?

- Pourquoi collecter 100% des données machine est une erreur coûteuse et inutile ?

- IA embarquée (On-Device AI) : pourquoi ne pas envoyer vos images de production dans le Cloud ?

Pourquoi vos modèles d’IA échouent : le problème des données « sales » issues des vieux automates

Avant de vanter les mérites du Machine Learning, posons un garde-fou réaliste qui parlera à tout DSI industriel : la qualité des données. Le principe « Garbage In, Garbage Out » est dix fois plus vrai en IA. Vous pouvez avoir le meilleur algorithme du monde, s’il est alimenté par des données bruitées, incohérentes ou mal horodatées provenant d’un automate des années 90, il produira des résultats au mieux inutiles, au pire dangereux.

Les systèmes legacy, bien que robustes, n’ont pas été conçus pour la data science. Leurs capteurs peuvent avoir des dérives, les formats de logs peuvent être non structurés et la connectivité peut être intermittente. Lancer un projet IA sans un audit préalable de la chaîne de collecte de données est le plus sûr moyen de le voir échouer. L’IA industrielle n’a de valeur que si les données sont fiables et contextualisées, un point critique souvent sous-estimé dans les business cases.

La première étape d’un projet IA rentable n’est donc pas l’achat d’une solution, mais un travail d’ingénierie des données : nettoyer, normaliser, enrichir et valider les flux existants. C’est un coût initial, certes, mais il doit être mis en balance avec le coût bien plus élevé d’un modèle qui prendrait des décisions erronées. La qualité des données est une condition non négociable, car selon les experts du secteur industriel, sans elles, l’intelligence artificielle est tout simplement inutile. Cet investissement initial en « plomberie » de données est en réalité le fondement de tout ROI futur.

Défauts inconnus : pourquoi l’apprentissage non-supervisé est le seul choix pour la détection d’anomalies rares ?

C’est ici que l’arbitrage entre `IF-THEN` et ML devient limpide. Un système programmé peut uniquement trouver ce pour quoi il a été explicitement codé. Pour détecter un défaut, un ingénieur doit d’abord l’identifier, le caractériser, puis écrire une règle : « SI la rayure mesure plus de 0.5mm ET se trouve dans la zone 3, ALORS rejeter la pièce ». Mais que se passe-t-il si un nouveau type de défaut apparaît, une décoloration subtile ou une micro-fissure imprévue ? Le système `IF-THEN` est aveugle. C’est un coût d’inflexibilité majeur : le temps que le défaut soit découvert, des milliers de pièces peuvent avoir été produites.

L’apprentissage non-supervisé change complètement la donne. Au lieu de lui apprendre à reconnaître des défauts spécifiques, vous lui montrez des milliers d’exemples de ce qu’est une pièce « normale ». Le modèle apprend la distribution statistique de la normalité dans ses moindres détails. Dès qu’une pièce présente une caractéristique qui s’écarte de cette norme apprise, même de façon infime et jamais vue auparavant, le modèle la signale comme une « anomalie ».

Ce paradigme est une révolution pour le contrôle qualité. L’étude de cas sur l’apprentissage non-supervisé pour la cybersécurité industrielle l’illustre parfaitement : en apprenant le comportement normal des machines, les algorithmes détectent automatiquement les déviations sans avoir besoin d’un catalogue de toutes les cyberattaques possibles. C’est la capacité à gérer l’inconnu qui donne sa véritable valeur au ML. Le ROI ne vient pas de la simple automatisation, mais de la capture de problèmes qui, autrement, seraient passés inaperçus, générant des coûts de non-qualité bien plus tard dans la chaîne.

Du labo à l’usine : comment mettre à jour un modèle IA en production sans arrêter la ligne ?

Le DSI pragmatique se posera la question suivante : « Très bien, le modèle est flexible. Mais cette flexibilité ne se paie-t-elle pas par une complexité de maintenance exorbitante ? ». L’image du data scientist qui passe des semaines à ré-entraîner un modèle dans son « laboratoire » avant un déploiement manuel risqué est une crainte légitime. Si chaque adaptation du modèle nécessite un arrêt de ligne ou une intervention manuelle complexe, le ROI s’effondre. C’est un point critique, car seulement 13% des projets IA sont déployés avec succès et appliqués à grande échelle, souvent à cause de cet écueil.

La réponse à cette problématique se nomme MLOps (Machine Learning Operations). Il s’agit d’appliquer les principes du DevOps (intégration continue, déploiement continu) au cycle de vie des modèles de ML. Loin d’être un processus artisanal, la mise à jour d’un modèle en production doit être une procédure automatisée, sécurisée et, surtout, sans interruption. Des stratégies comme le « shadow deployment » (où le nouveau modèle tourne en parallèle de l’ancien sans prendre de décision, juste pour comparer ses prédictions) ou le « canary deployment » (où le nouveau modèle ne traite qu’un petit pourcentage du flux) permettent de valider la performance en conditions réelles avant de basculer complètement.

Ces approches garantissent que le passage d’un modèle v1 à un modèle v2 est transparent pour la production. L’orchestration des déploiements sur une flotte d’équipements « Edge » peut être centralisée, assurant que toutes les machines disposent de la même version du modèle au même moment. Cette industrialisation du cycle de vie de l’IA est la clé pour que la flexibilité du modèle ne devienne pas un cauchemar de maintenance. C’est un domaine d’ingénierie mature avec des outils et des méthodes éprouvés.

Plan d’action : Votre checklist pour un déploiement IA industriel robuste

- Serveurs d’inférence : Utilisez-vous des technologies asynchrones comme FastAPI pour traiter les requêtes en parallèle et ne pas créer de goulot d’étranglement ?

- Gestion des tâches : Avez-vous implémenté des tâches de fond (ex: avec Starlette) pour que les inspections longues ne bloquent pas le flux principal de la ligne ?

- Reproductibilité du déploiement : Votre processus de déploiement s’appuie-t-il sur des conteneurs (Docker) et des outils d’automatisation (Ansible) pour garantir la cohérence sur toute la flotte ?

- Orchestration centrale : Disposez-vous d’un Hub central pour gérer et superviser les déploiements sur de multiples dispositifs Edge simultanément ?

- Architecture modulaire : Avez-vous bien séparé la logique d’orchestration (Edge Orchestrator) de la logique de service du modèle (Edge Model Serving) pour faciliter les mises à jour indépendantes ?

Boîte noire : comment expliquer à l’opérateur pourquoi l’IA a rejeté une pièce apparemment bonne ?

L’une des objections les plus fortes à l’IA en usine n’est pas technique, mais humaine. Un opérateur de ligne, avec ses 20 ans d’expérience, ne fera jamais confiance à un système qui lui dit « Rejet » sans aucune explication, surtout si la pièce lui semble parfaite à l’œil nu. Si l’IA reste une « boîte noire », elle créera de la friction, de la méfiance et sera au final contournée. Le ROI d’une technologie non adoptée par les utilisateurs terrain est nul.

Heureusement, le domaine de l’IA Explicable (XAI) a fait d’énormes progrès. Il existe aujourd’hui des outils et des méthodes pour « ouvrir » la boîte noire et traduire la décision d’un modèle en termes compréhensibles. Pour une tâche de contrôle qualité par image, par exemple, des techniques comme les « heatmaps » (cartes de chaleur) peuvent surligner précisément la zone de l’image qui a le plus influencé la décision de rejet. L’opérateur ne voit plus un simple « Rejet », mais une image avec une micro-fissure ou une variation de texture surlignée en rouge, qu’il n’aurait peut-être pas vue lui-même.

Comme le souligne une étude sur l’explicabilité menée dans 17 organisations, des outils comme SHAP ou LIME permettent de quantifier la contribution de chaque variable d’entrée à la décision finale. L’explication n’est plus une vague intuition, mais une analyse factuelle. L’objectif n’est pas de soumettre l’opérateur à la machine, mais de lui donner un outil plus performant, un « super-œil » qui augmente ses capacités. Comme le disent Chabanet et Richard dans leur analyse, l’enjeu est de garantir que les opérateurs ne soient jamais soumis ni à la machine ni aux experts. L’adoption de l’IA sur le terrain dépend directement de cette capacité à fournir des explications claires et actionnables, transformant une décision opaque en un dialogue constructif.

TinyML : faire tourner une IA sur un microcontrôleur à 5€, est-ce possible ?

L’image d’une IA gourmande en ressources, nécessitant des racks de serveurs GPU coûteux, est un frein majeur pour de nombreux projets industriels. Si chaque point de contrôle sur une ligne de production requiert un PC industriel à 3000€, le calcul du ROI devient vite défavorable. C’est ici qu’intervient une branche fascinante et pragmatique de l’IA : le TinyML.

Le TinyML consiste à optimiser et compresser des modèles de Machine Learning pour qu’ils puissent s’exécuter sur des microcontrôleurs (MCU) à très faible consommation et très faible coût, parfois quelques euros à peine. Oui, il est non seulement possible, mais de plus en plus courant, de faire tourner des algorithmes de détection d’anomalies sonores, de vision simple ou d’analyse de vibrations directement sur le capteur lui-même.

Le projet VIO (Visual Inspection Orchestrator) est un excellent exemple de cette approche. En déployant l’IA sur du matériel de commodité, il permet une inspection visuelle en temps réel avec des contraintes fortes, directement sur la ligne. L’inférence se fait localement (on parle d’IA « Edge »), sans avoir besoin d’envoyer un flux vidéo constant vers un serveur central. Cela présente des avantages financiers évidents en termes de coût matériel, mais aussi en termes de bande passante réseau et de consommation électrique. Cette approche décentralisée permet d’envisager un déploiement massif de l’intelligence à des endroits jusqu’ici inaccessibles pour des raisons de coût, changeant radicalement l’équation économique.

Comment calculer votre ROI robotique sur 3 ans sans oublier les coûts cachés ?

Nous arrivons au cœur de l’arbitrage. Un calcul de ROI classique pour un projet de programmation `IF-THEN` est simple : coût du développement vs gains de productivité. Mais cette approche est dangereusement incomplète car elle ignore le principal passif de cette approche : sa rigidité. Le véritable calcul de ROI doit être comparatif et intégrer le Coût de l’Inflexibilité (COI).

Sur 3 ans, un système `IF-THEN` va engendrer des coûts cachés significatifs : les heures d’ingénierie pour chaque nouvelle règle à ajouter, le temps de qualification, les arrêts de ligne potentiels pendant les mises à jour, et surtout, le coût d’opportunité des défauts non détectés car non prévus. À l’inverse, un modèle de Machine Learning, bien que plus cher à l’investissement initial (collecte et labellisation des données, entraînement), possède une capacité de généralisation. Son coût de maintenance est lié à des ré-entraînements périodiques, mais il s’adapte nativement à une grande partie de la variabilité de la production sans intervention. Des analyses montrent que les entreprises manufacturières constatent des réductions de coûts opérationnels allant de 25% à 40% dans les 18 premiers mois suivant l’implémentation de solutions d’IA.

Le tableau suivant synthétise cet arbitrage financier sur un horizon de 3 ans.

| Critère d’évaluation | Programmation IF-THEN | Machine Learning |

|---|---|---|

| Investissement initial (Année 1) | Faible à moyen | Élevé (collecte, labellisation données) |

| Coût de maintenance annuel | Élevé (reprogrammation fréquente) | Moyen (ré-entraînement adaptatif) |

| Flexibilité face aux changements | Rigide – reprogrammation complète | Élevée – généralisation automatique |

| Gestion des cas imprévus | 0% (nécessite code supplémentaire) | Élevée (généralisation apprise) |

| ROI à 18 mois | Positif mais plafonné | Positif avec croissance continue |

| Coût de l’inflexibilité (COI) | Très élevé (heures ingénierie) | Quasi-nul (adaptation automatique) |

La conclusion est claire : évaluer l’IA sur la base de son coût initial est une erreur d’analyse. C’est son aptitude à absorber l’imprévu et à réduire drastiquement le COI sur le moyen et long terme qui constitue son véritable retour sur investissement.

Pourquoi collecter 100% des données machine est une erreur coûteuse et inutile ?

Face à la promesse du Big Data, une réaction fréquente est de vouloir tout collecter. « Stockons tout, on verra plus tard ce qu’on en fait ». C’est une stratégie qui mène souvent à des « lacs de données » qui se transforment en « marécages de données » : des volumes gigantesques d’informations coûteuses à stocker, difficiles à naviguer, et finalement inexploitées. Aujourd’hui, bien que le potentiel soit là, seulement 10% des entreprises implantées en France déclarent utiliser au moins une technologie d’IA, et ce n’est pas par manque de données, mais souvent par manque de stratégie.

Une démarche IA rentable commence à l’envers. Elle ne part pas des données, mais du problème métier à résoudre. Quel est l’indicateur de performance (KPI) que l’on cherche à améliorer ? La réduction du taux de rebut ? L’optimisation de la consommation énergétique ? La maintenance prédictive ? C’est seulement une fois l’objectif business clairement défini que l’on peut identifier les données pertinentes à collecter.

La captation de données est souvent déjà en place grâce aux automates. On sait stocker les données, mais on ne sait pas encore la valoriser de manière cohérente. Souvent, les projets d’IA sont lancés sans lien direct avec les objectifs business.

– Pacôme Perez, ancien responsable IA chez Orano, Techniques de l’Ingénieur

Cette citation est fondamentale. L’enjeu n’est pas la quantité, mais la pertinence. Collecter un petit nombre de signaux de haute qualité, directement corrélés au problème métier, est infiniment plus rentable que de noyer les data scientists sous des téraoctets de données bruitées. La stratégie de données doit être guidée par le ROI attendu, et non par une boulimie technologique. Un projet IA réussi est un projet frugal en données, mais riche en insights.

À retenir

- La rentabilité de l’IA ne se juge pas sur le coût initial mais sur le coût total de possession sur 3 ans, incluant le « Coût de l’Inflexibilité » du code rigide.

- L’IA excelle là où le code `IF-THEN` échoue : la gestion de l’imprévu et des variations, grâce à l’apprentissage non-supervisé et à la généralisation.

- Les freins à l’adoption (maintenance, « boîte noire », coût matériel) sont aujourd’hui adressés par des solutions matures comme le MLOps, l’IA Explicable (XAI) et le TinyML.

IA embarquée (On-Device AI) : pourquoi ne pas envoyer vos images de production dans le Cloud ?

La dernière pièce du puzzle de la rentabilité concerne l’architecture. Le réflexe « Cloud » a dominé l’informatique de la dernière décennie, mais pour l’IA industrielle, il montre ses limites. Envoyer des centaines de flux vidéo haute résolution depuis l’atelier vers un datacenter distant pour analyse pose des problèmes majeurs : latence, coût de la bande passante, et surtout, sécurité et souveraineté des données de production.

La solution la plus robuste et la plus rentable est souvent une architecture hybride, qui tire le meilleur des deux mondes : l’IA embarquée (On-Device ou Edge AI) pour le traitement en temps réel, et le Cloud pour l’entraînement et l’analyse agrégée. Concrètement, l’inférence (la prise de décision) se fait localement, sur un équipement au plus près de la machine. Seules les données pertinentes (ex: une image de défaut avec les métadonnées, ou simplement un compteur de rejets) sont ensuite envoyées au Cloud. Cette approche garantit une réponse en temps réel, une grande autonomie en cas de perte de connexion réseau, et la confidentialité des données sensibles qui ne quittent jamais l’enceinte de l’usine.

Comme le souligne une analyse de KPMG, les entreprises leaders déploient des infrastructures hybrides pour garantir sécurité et évolutivité. L’industrie a besoin de solutions autonomes, capables de tourner sur des systèmes critiques. C’est le passage d’une IA centralisée à une intelligence distribuée, directement intégrée dans le processus physique de production. Pour un DSI, c’est l’assurance d’un système résilient, sécurisé et performant, qui ne fait pas exploser les factures de l’opérateur Cloud.

En conclusion, l’arbitrage « Machine Learning vs Programmation » est un faux débat s’il reste purement technique. En le repositionnant sur le terrain économique du Coût de l’Inflexibilité et du ROI à 3 ans, vous disposez d’une grille de lecture puissante pour justifier vos investissements. L’étape suivante consiste à identifier un premier cas d’usage à fort impact et à faible complexité pour démontrer la valeur de cette approche dans votre contexte spécifique.