Traiter les données IA sur le robot n’est pas une optimisation, mais une décision stratégique de contrôle et de souveraineté sur vos actifs les plus critiques.

- La latence n’est plus un délai, elle devient une capacité d’action physique en temps réel.

- La confidentialité de vos secrets de fabrication est absolue, car les données ne quittent jamais le périmètre de la machine.

Recommandation : Auditez vos flux de données pour identifier les cas d’usage où l’inférence locale crée une valeur non-négociable et sécurise votre avantage concurrentiel.

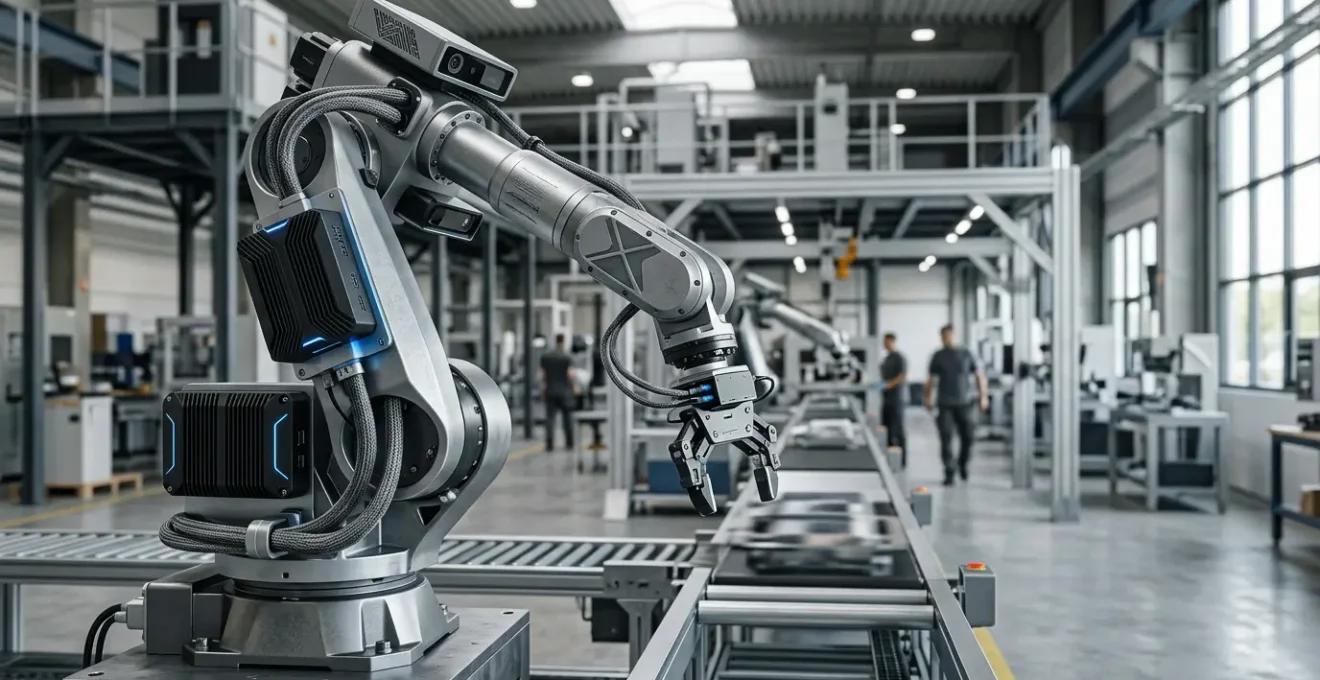

En tant que DSI, chaque décision d’innovation est une balance entre le potentiel de performance et le risque. L’intelligence artificielle en vision industrielle promet une révolution, mais elle s’accompagne d’une question fondamentale : où traiter les données ? L’approche par défaut, consistant à envoyer des flux vidéo continus vers le Cloud pour analyse, expose vos processus, vos recettes et vos secrets de fabrication à une surface d’attaque élargie. La latence du réseau, la dépendance à la connectivité et les coûts de bande passante ne sont que la partie visible de l’iceberg.

Cette approche centralisée soulève une préoccupation majeure : la perte de souveraineté. Chaque image de production envoyée à l’extérieur est une fuite potentielle d’avantage concurrentiel. Mais si la véritable clé n’était pas d’optimiser le transfert vers le Cloud, mais de l’éliminer complètement pour les tâches critiques ? L’IA embarquée, ou On-Device AI, inverse le paradigme. L’inférence ne se fait plus dans un data center distant, mais directement sur le processeur du robot, au cœur de l’action.

Cet article n’est pas une simple comparaison technique. C’est un guide stratégique destiné aux DSI pour comprendre pourquoi et comment l’IA embarquée constitue une forteresse pour vos données et un levier de performance inégalé. Nous allons décortiquer les implications de ce choix, du processeur à la gestion de flotte, pour transformer la contrainte de la confidentialité en un avantage opérationnel décisif.

Pour explorer en détail les facettes de cette approche stratégique, cet article est structuré pour répondre aux questions clés que se pose un DSI. Chaque section aborde un défi spécifique et démontre comment l’IA embarquée y apporte une solution directe et efficace.

Sommaire : IA embarquée, la nouvelle frontière de la souveraineté des données industrielles

- Edge Computing : pourquoi traiter les données au pied de la machine plutôt que dans le serveur central ?

- Jetson ou TPU : quel processeur pour faire tourner un réseau de neurones sur le robot ?

- Inférence locale : gagner les 200ms qui permettent d’éjecter la pièce défectueuse à la volée

- Fleet Management : comment déployer un nouveau modèle IA sur 50 robots sans clé USB ?

- IA basse consommation : faire de la détection de personne sur batterie, un défi possible ?

- Mode déconnecté : assurer la qualité même quand le WiFi de l’usine tombe en panne

- TinyML : faire tourner une IA sur un microcontrôleur à 5€, est-ce possible ?

- Filtrage à la source : n’envoyez que les alertes au Cloud, pas les téraoctets de bruit

Edge Computing : pourquoi traiter les données au pied de la machine plutôt que dans le serveur central ?

Le principe du Edge Computing est simple : rapprocher le calcul de la source de la donnée. Pour un DSI, cela signifie passer d’un modèle où des téraoctets de données brutes traversent votre réseau vers un serveur central ou le Cloud, à un modèle où seule l’information pertinente et pré-analysée est transmise. Cette décentralisation n’est pas une simple optimisation, c’est un changement architectural fondamental. Le périmètre de confiance se rétrécit radicalement, passant de l’ensemble de votre infrastructure réseau à la machine elle-même. C’est une réponse directe à la problématique de la confidentialité des secrets de fabrication.

L’enjeu est colossal, et le marché ne s’y trompe pas. Avec une valorisation estimée à 12,5 milliards USD en 2024 et une croissance explosive attendue, l’Edge AI n’est plus une niche, mais la nouvelle norme pour les applications critiques. Traiter les données localement permet une résilience opérationnelle accrue : une panne de réseau n’arrête plus la production ou le contrôle qualité. De plus, cela réduit drastiquement la charge sur l’infrastructure réseau et les coûts associés au stockage et au traitement dans le Cloud.

Étude de cas : Réduction des coûts énergétiques et des transferts de données

L’Edge Computing permet de réduire la quantité de données transitant dans le réseau et d’améliorer la latence en accédant aux données plus rapidement par traitement de proximité. Traiter au plus près peut éliminer une partie des transferts de données in situ et, par corollaire, réduire les consommations énergétiques correspondantes, tout en améliorant la résilience grâce à des modes de fonctionnement hors ligne.

Comme le résume parfaitement Embedded France, l’IA embarquée est un pilier de la prochaine décennie, convergeant avec l’Edge Computing, la cybersécurité et les nouvelles exigences réglementaires.

L’IA embarquée s’impose ainsi comme l’un des piliers technologiques clés de la prochaine décennie, convergeant naturellement avec l’Edge Computing, les architectures distribuées, les normes de sûreté et de cybersécurité, ainsi qu’avec les nouvelles exigences réglementaires européennes.

– Embedded France, Groupe de Travail IA Embarquée

Adopter l’Edge AI, c’est donc reprendre le contrôle total de vos données et de vos opérations, en transformant une contrainte de sécurité en un avantage de performance et de résilience.

Jetson ou TPU : quel processeur pour faire tourner un réseau de neurones sur le robot ?

Une fois la décision stratégique du traitement local actée, la question devient tactique : quel hardware choisir ? Le débat se cristallise souvent autour de deux philosophies : les GPU (Graphics Processing Units) comme la série NVIDIA Jetson, et les ASIC (Application-Specific Integrated Circuits) comme les Google Edge TPU. Ce n’est pas un choix de marque, mais un choix d’architecture. Les GPU sont des processeurs polyvalents, excellents pour le traitement parallèle massif requis par des réseaux de neurones complexes et variés. Ils offrent une grande flexibilité pour développer et tester différents modèles.

À l’inverse, les TPU sont des circuits spécialisés, conçus et optimisés pour une seule tâche : exécuter les opérations de tensor de manière extrêmement efficace et avec une faible consommation d’énergie. Ils sont idéaux pour une inférence à grande échelle une fois le modèle finalisé et « gelé ». Le choix dépend donc de votre maturité projet : flexibilité et puissance brute (GPU) contre efficacité et spécialisation (ASIC). Le marché des processeurs de vision Edge AI connaît une croissance fulgurante, qui devrait passer de 6,06 milliards USD en 2024 à 46,4 milliards USD d’ici 2032, témoignant de l’importance de ce choix matériel.

Étude de cas : NVIDIA Jetson Thor pour l’Edge AI industrielle

En février 2025, NVIDIA a introduit la plateforme Jetson Thor, son module Edge AI le plus avancé, conçu pour la robotique et les machines autonomes. Avec plus de 800 TOPS de performance IA, la plateforme permet une prise de décision en temps réel pour les usines intelligentes, démontrant la montée en puissance des architectures GPU pour l’inférence embarquée.

Plan d’action : Votre checklist pour choisir un processeur Edge AI

- Cas d’usage et complexité du modèle : Listez les tâches IA (détection, classification, segmentation). Un modèle complexe et évolutif favorise un GPU. Un modèle simple et fixe, un ASIC.

- Contraintes énergétiques et thermiques : Inventoriez l’enveloppe de consommation (en watts) et l’espace de dissipation thermique disponible sur le robot. Les ASIC sont souvent plus frugaux.

- Écosystème logiciel et compétences : Confrontez les frameworks supportés (TensorFlow Lite pour Edge TPU, CUDA/TensorRT pour Jetson) aux compétences de vos équipes. L’écosystème NVIDIA est plus mature mais peut être plus complexe.

- Performance/Latence requise : Repérez le temps de cycle de votre processus (en ms). Le benchmark doit être fait sur le modèle cible réel pour valider la performance en conditions opérationnelles.

- Coût et scalabilité : Évaluez le coût par unité et la feuille de route du fournisseur pour garantir la pérennité et la disponibilité des composants pour un déploiement sur l’ensemble de la flotte.

La sélection du processeur n’est pas une fin en soi, mais le moyen d’atteindre un objectif métier précis : la réactivité.

Inférence locale : gagner les 200ms qui permettent d’éjecter la pièce défectueuse à la volée

Pourquoi la latence est-elle l’indicateur le plus critique en robotique industrielle ? Parce qu’elle conditionne la capacité d’agir. Envoyer une image au Cloud, attendre l’analyse et recevoir la réponse peut prendre de 500ms à plus d’une seconde. Pendant ce temps, la pièce sur le convoyeur a déjà parcouru plusieurs mètres. L’inférence locale, elle, se mesure en dizaines de millisecondes. Ce gain de temps n’est pas une simple optimisation ; c’est ce qui rend possible une inférence actionnable.

C’est la différence entre marquer une pièce comme défectueuse pour un tri ultérieur et l’éjecter physiquement de la ligne de production à la volée. L’impact sur la qualité et l’efficacité est direct. Pour le comprendre, l’analogie avec les véhicules autonomes est parlante : un délai de 100 millisecondes à vitesse autoroutière peut représenter plusieurs mètres de distance parcourue. En usine, ces millisecondes déterminent si un robot peut intervenir à temps pour corriger un défaut, éviter une collision ou garantir la sécurité d’un opérateur.

L’inférence locale permet des latences de l’ordre de dizaines de millisecondes au lieu de centaines, une meilleure confidentialité car les données sensibles restent sur l’appareil, et des économies sur la bande passante et les coûts cloud.

– Auteur technique, Investir Mag – Optimiser l’IA en périphérie pour des applications temps réel

En ramenant l’intelligence au plus près de l’actionneur, vous transformez le robot d’un simple collecteur de données en un agent autonome et réactif. Pour un DSI, c’est la garantie que les systèmes critiques de production ne sont pas à la merci des aléas d’une connexion réseau. C’est la transformation de la donnée en action physique, instantanée et fiable.

Fleet Management : comment déployer un nouveau modèle IA sur 50 robots sans clé USB ?

Le premier robot est une preuve de concept. Le cinquantième est un défi de déploiement. La gestion manuelle d’une flotte de dispositifs intelligents via des clés USB est une impasse opérationnelle : elle est source d’erreurs, de versions hétérogènes et de failles de sécurité. Pour un DSI, la scalabilité passe par des plateformes de Fleet Management centralisées, conçues pour l’Edge. Ces solutions permettent le déploiement atomique et sécurisé de nouvelles versions de modèles IA ou de mises à jour logicielles sur l’ensemble du parc en un clic.

L’enjeu est de garantir l’homogénéité, la traçabilité et la sécurité des déploiements. Des technologies comme la conteneurisation (Docker) sont au cœur de ces plateformes, permettant d’embarquer un modèle et ses dépendances dans un package isolé et reproductible. Le déploiement se fait « Over-The-Air » (OTA), sans intervention physique. Le marché est mature, avec plus de 4,1 millions de robots industriels actifs, dont 63% s’appuient sur une prise de décision IA localisée, ce qui rend ces outils de gestion indispensables.

Étude de cas : Déploiement Edge AI 800% plus rapide avec Barbara Tech

La plateforme Barbara Tech permet un déploiement de nouvelles applications d’IA 800% plus rapide sur l’ensemble du parc de véhicules autonomes. La solution surveille les performances des modèles sur le terrain et permet des mises à jour itératives sans immobiliser les véhicules, grâce au support natif de Docker Swarm qui garantit que les services critiques restent opérationnels même en cas de défaillance d’un nœud.

Ces plateformes ne se contentent pas de pousser des mises à jour. Elles permettent également de monitorer la performance des modèles en conditions réelles, de collecter des données de terrain pour le ré-entraînement (uniquement les cas d’échec, par exemple) et d’effectuer des retours en arrière (rollback) en cas de problème. C’est la mise en place d’une véritable boucle CI/CD (Intégration Continue / Déploiement Continu) pour l’IA embarquée, un prérequis pour industrialiser l’intelligence à l’échelle de l’usine.

IA basse consommation : faire de la détection de personne sur batterie, un défi possible ?

L’un des freins historiques à l’IA embarquée était la consommation énergétique. Faire tourner un réseau de neurones est une tâche intensive qui peut rapidement vider une batterie ou créer des problèmes thermiques. Ce défi est aujourd’hui largement relevé grâce à une triple approche : matérielle, logicielle et algorithmique. Au niveau matériel, l’émergence de processeurs dédiés, les NPU (Neural Processing Units), change la donne. Conçus spécifiquement pour les calculs matriciels de l’IA, ils sont bien plus efficaces énergétiquement que les CPU ou même les GPU pour l’inférence.

Au niveau logiciel et algorithmique, des techniques comme la quantization et le pruning permettent de réduire drastiquement la taille et la complexité des modèles sans sacrifier significativement la précision. La quantization consiste à réduire la précision des poids du modèle (passer de 32-bit à 8-bit, par exemple), ce qui diminue l’empreinte mémoire et la charge de calcul. Le pruning, lui, consiste à supprimer les connexions neuronales les moins importantes du réseau. Ces optimisations, combinées à des NPU, permettent des gains considérables. Les données du marché Edge AI 2025 indiquent une réduction moyenne de 28% de la consommation d’énergie grâce à ces processeurs écoénergétiques.

Grâce à ces avancées, des applications comme la détection de personnes sur des robots mobiles autonomes (AGV) ou des drones fonctionnant sur batterie deviennent non seulement possibles, mais également fiables sur de longues périodes. Le défi n’est plus la faisabilité, mais l’optimisation fine entre la performance du modèle et l’autonomie du système. C’est un travail d’architecte qui consiste à trouver le meilleur compromis pour le cas d’usage spécifique, en s’assurant que l’intelligence embarquée ne se fait pas au détriment de la durée de vie opérationnelle du robot.

Mode déconnecté : assurer la qualité même quand le WiFi de l’usine tombe en panne

La dépendance à une connectivité réseau stable est l’un des plus grands risques pour une production industrielle moderne. Un micro-coupure WiFi, une saturation de la bande passante, une panne de switch… et c’est toute la chaîne de contrôle qualité basée sur le Cloud qui s’arrête. Pour un DSI, garantir la continuité d’activité est une priorité absolue. C’est précisément là que l’IA embarquée démontre sa supériorité en termes de résilience opérationnelle. Puisque l’inférence, la décision et l’action se déroulent entièrement sur le robot, le système est immunisé contre les aléas du réseau.

Le robot continue de détecter les défauts, de trier les pièces et de garantir la qualité, même en mode totalement déconnecté. Les alertes critiques ou les rapports de synthèse peuvent être mis en file d’attente et transmis dès que la connexion est rétablie. Cette autonomie n’est pas un luxe, mais une assurance. Elle garantit que la production ne s’arrête pas à cause d’un problème d’infrastructure IT. Cette prise de conscience pousse l’adoption : plus de 39% des entreprises ont déjà adopté l’inférence IA localisée pour réduire leur dépendance au Cloud.

Étude de cas : Inférence ultra-rapide et résilience totale en cas de coupure

Les solutions Edge AI embarquées offrent une inférence ultra-rapide et une résilience totale, même en cas de coupure de connectivité. Le support natif de Docker Swarm permet aux systèmes de redistribuer automatiquement les charges de travail en cas de défaillance d’un nœud, garantissant un temps de fonctionnement maximal pour les systèmes de sécurité et de navigation sans dépendance au réseau.

En choisissant une architecture d’IA embarquée, vous ne faites pas qu’améliorer la latence ou la confidentialité. Vous construisez un système de production fondamentalement plus robuste. Vous dissociez la performance de vos processus critiques de la fiabilité de votre connectivité. C’est un pas décisif vers l’usine « zéro arrêt », où chaque machine possède l’intelligence nécessaire pour fonctionner de manière autonome et fiable, quelles que soient les conditions extérieures.

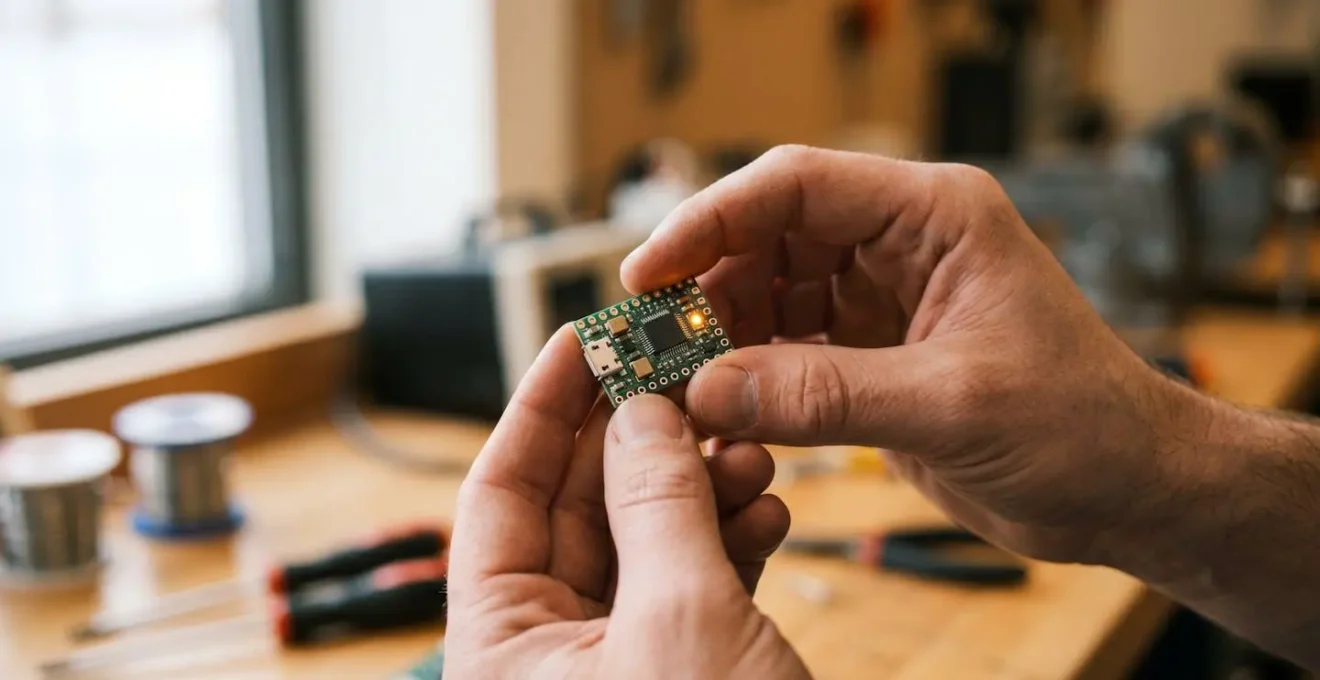

TinyML : faire tourner une IA sur un microcontrôleur à 5€, est-ce possible ?

L’IA embarquée n’est pas réservée aux robots surpuissants équipés de GPU. Une nouvelle discipline, le TinyML (Tiny Machine Learning), démocratise l’intelligence en la rendant accessible à des dispositifs extrêmement contraints : les microcontrôleurs (MCU). Ces puces, qui coûtent souvent quelques euros, sont le cerveau de milliards d’appareils, des capteurs industriels aux appareils électroménagers. Le défi du TinyML est de faire tourner des modèles d’inférence dans un environnement où les ressources sont drastiquement limitées.

Qu’est-ce qu’un environnement contraint ? Les directives proposées pour définir le TinyML évoquent moins de 1 Mo de RAM et une consommation inférieure à 1 mW. C’est un ordre de grandeur bien inférieur à celui des smartphones ou même des Raspberry Pi. Pour y parvenir, le TinyML s’appuie sur des modèles ultra-optimisés et des frameworks spécialisés comme TensorFlow Lite for Microcontrollers. Les applications sont vastes : maintenance prédictive par analyse de vibrations sur un moteur, détection de mots-clés audio (« wake words ») pour une commande vocale, ou encore détection d’anomalies simple sur un capteur visuel basse résolution.

TinyML est une discipline émergente pour développer des implémentations rapides, peu gourmandes en ressources et économes en énergie d’algorithmes de machine learning qui peuvent être opérationnalisés sur des microcontrôleurs à ressources limitées.

– Matthew Stewart, PhD candidate, Harvard University, Elektor Magazine – Tiny Machine Learning

Pour un DSI, le TinyML ouvre la porte à l’instrumentation intelligente de l’ensemble du parc de machines, et pas seulement des robots les plus avancés. C’est la possibilité de déployer de l’intelligence à très bas coût et à très grande échelle, pour collecter des informations fines et déclencher des actions locales simples, en transformant chaque capteur en un nœud intelligent et autonome.

À retenir

- Souveraineté des données : L’IA embarquée est une décision stratégique qui garantit que vos secrets de fabrication ne quittent jamais l’enceinte de la machine.

- Inférence actionnable : La réduction drastique de la latence n’est pas un simple gain de vitesse, c’est ce qui permet au robot d’interagir physiquement avec son environnement en temps réel.

- Résilience et scalabilité : Les architectures locales assurent la continuité de la production même en cas de panne réseau, et les plateformes de Fleet Management permettent un déploiement industriel maîtrisé.

Filtrage à la source : n’envoyez que les alertes au Cloud, pas les téraoctets de bruit

L’un des arguments les plus puissants en faveur de l’IA embarquée est économique et écologique : l’efficacité. Un système de vision industrielle peut générer des plusieurs gigaoctets de données opérationnelles par jour. Dans un modèle Cloud-centric, 99.9% de ces données représentent un état normal, du « bruit » informationnel. Envoyer ce bruit vers le Cloud pour analyse est un gaspillage de ressources à tous les niveaux : bande passante, stockage, puissance de calcul et, par conséquent, énergie.

Le filtrage à la source est une stratégie de bon sens. Le modèle d’IA embarqué sur le robot analyse le flux en temps réel et ne transmet que les informations pertinentes : les alertes de défaut, les images des pièces non conformes, les statistiques de production agrégées. Au lieu d’un flux vidéo continu, vous ne transmettez que des événements à haute valeur ajoutée. L’impact sur l’infrastructure est immédiat et massif. Vous libérez de la bande passante pour des usages plus critiques et réduisez vos factures Cloud de manière spectaculaire.

Cette approche a également un impact environnemental non négligeable. Comme le soulignait Cisco, le trafic de données a un coût énergétique caché très important.

Pour chaque bit de données qui transite par le réseau des centres de données jusqu’aux utilisateurs finaux, cinq autres bits sont transmis à l’intérieur et entre les centres de données. Or chaque transfert de données consomme de l’énergie, mobilise des équipements.

– Cisco, Étude Cisco 2018 citée par Advaes

En adoptant une stratégie de filtrage à la source, vous concevez une architecture IT plus légère, plus réactive et plus responsable. Vous transformez vos robots en sentinelles intelligentes qui ne vous sollicitent qu’en cas de nécessité, laissant le réseau et les systèmes centraux se concentrer sur les tâches qui requièrent une vision globale.

En définitive, l’adoption de l’IA embarquée transcende la simple optimisation technique. C’est un choix architectural qui replace la souveraineté, la sécurité et la résilience au cœur de votre stratégie industrielle. L’étape suivante consiste à auditer vos processus de production pour identifier les points critiques où la latence et la confidentialité sont non-négociables, et ainsi construire votre feuille de route vers une intelligence véritablement autonome.