L’Edge Computing n’est pas une guerre contre le Cloud, mais la solution tactique pour désengorger votre réseau OT et donner une intelligence locale et réactive à vos machines existantes.

- Il filtre les données à la source pour ne remonter que les alertes critiques, libérant ainsi une bande passante précieuse.

- Il permet une réactivité en millisecondes, impossible via le Cloud, pour des actions comme le contrôle qualité à la volée.

Recommandation : Commencez par équiper une ligne de production critique d’une passerelle Edge pour un projet pilote mesurable et démontrer rapidement la valeur.

En tant qu’architecte réseau industriel, vous connaissez la frustration : des capteurs qui génèrent des téraoctets de données, une bande passante qui frôle la saturation et une latence qui interdit toute action corrective en temps réel. La réponse habituelle a longtemps été de tout centraliser dans le Cloud, en espérant que des serveurs distants puissent résoudre des problèmes locaux. Cette approche montre aujourd’hui ses limites, créant des goulots d’étranglement et une dépendance critique à une connexion internet stable.

Mais si la véritable clé n’était pas de choisir entre le traitement local et le Cloud, mais de les faire collaborer intelligemment ? Et si, au lieu de remplacer un parc machine fonctionnel mais vieillissant, on pouvait lui « greffer » une intelligence locale ? C’est précisément la promesse de l’Edge Computing : une approche décentralisée qui déplace une partie du calcul et de l’analyse au plus près de la source de données, directement au pied de la machine. Cette architecture ne s’oppose pas au Cloud ; elle le complète en agissant comme un premier filtre intelligent et ultra-réactif.

Cet article n’est pas un exposé théorique. C’est un guide pragmatique destiné aux architectes qui ont les mains dans les câbles et les protocoles. Nous allons explorer comment cette décentralisation de l’intelligence se matérialise concrètement sur le terrain, comment elle résout des problèmes de performance, de sécurité et de flexibilité, et surtout, comment l’adopter de manière progressive sans devoir repartir d’une feuille blanche.

Pour naviguer efficacement à travers les solutions concrètes que propose l’Edge Computing, cet article est structuré autour de cas d’usage et de points de décision stratégiques. Le sommaire ci-dessous vous guidera à travers les différentes facettes de cette révolution discrète mais puissante.

Sommaire : Déployer l’intelligence locale dans votre usine avec l’Edge Computing

- Filtrage à la source : n’envoyez que les alertes au Cloud, pas les téraoctets de bruit

- Automate logiciel sur PC Edge : la fin des automates matériels propriétaires ?

- Docker en industrie : déployer une application de vision comme une app sur smartphone

- Edge Gateway : le sas de sécurité qui protège votre vieil automate des attaques externes

- Boucle fermée locale : corriger la dérive de soudure milliseconde par milliseconde sans passer par le serveur

- Cloud ou Edge : où traiter vos données de vibration pour une réactivité millimétrique ?

- Inférence locale : gagner les 200ms qui permettent d’éjecter la pièce défectueuse à la volée

- Comment passer à l’Industrie 4.0 sans remplacer tout votre parc machine existant ?

Filtrage à la source : n’envoyez que les alertes au Cloud, pas les téraoctets de bruit

Le premier symptôme d’une architecture centralisée qui atteint ses limites est la saturation de la bande passante. Une seule caméra de contrôle qualité haute résolution ou une batterie de capteurs de vibrations peut générer un volume de données colossal. Envoyer ce flux brut vers le Cloud est non seulement coûteux, mais surtout inefficace. La majorité de ces données n’est que du « bruit » : des informations qui confirment que tout fonctionne normalement. L’Edge Computing inverse cette logique. En plaçant un dispositif de calcul (un « nœud Edge ») près de la machine, on peut analyser les données en temps réel et ne transmettre que l’essentiel : les anomalies, les alertes, les prédictions de panne. C’est un changement de paradigme fondamental qui explique pourquoi, selon les prévisions de Gartner, près de 75% des données d’entreprise seront traitées en périphérie d’ici 2025.

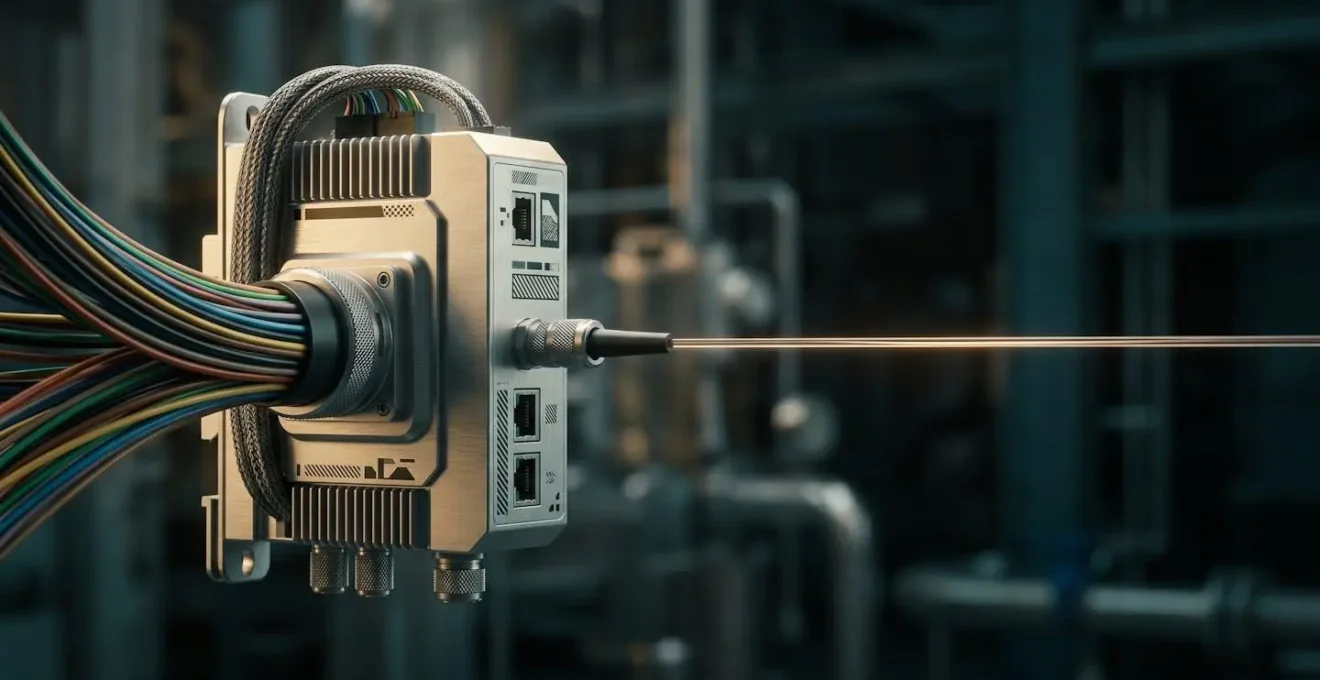

Cette approche permet de transformer un flot de données ingérable en un flux d’informations qualifiées et actionnables. L’illustration ci-dessous symbolise ce principe de filtrage intelligent, où seul le signal pertinent traverse le réseau pour atteindre les systèmes centraux.

Au-delà de la simple économie de bande passante, cette stratégie renforce la pertinence des analyses effectuées dans le Cloud. Plutôt que de noyer les data scientists sous des téraoctets de données brutes, on leur fournit des événements déjà contextualisés. Le Cloud ne sert plus de simple entrepôt, mais devient une plateforme d’analyse stratégique à long terme, nourrie par une intelligence locale efficace. Cette optimisation a un impact direct sur les coûts, comme le souligne une analyse du secteur.

En évitant en amont le transfert massif de données vers des datacenters distants, cette architecture réduit nettement les coûts liés à la bande passante.

– ObjetConnecte.com, Article sur l’edge computing dans l’industrie

En somme, le filtrage à la source n’est pas qu’une astuce technique ; c’est le premier pas vers une architecture de données plus sobre, plus intelligente et économiquement plus viable pour l’Industrie 4.0.

Automate logiciel sur PC Edge : la fin des automates matériels propriétaires ?

Le cœur battant de nombreuses usines reste l’Automate Programmable Industriel (API, ou PLC en anglais). Ces boîtiers matériels, souvent issus de grands noms comme Siemens ou Rockwell, sont robustes et fiables, mais aussi rigides, coûteux et basés sur des écosystèmes propriétaires. Leur mise à jour est complexe et leur intégration avec les technologies IT modernes relève souvent du casse-tête. L’Edge Computing propose une alternative disruptive : l’automate logiciel (ou Soft PLC). L’idée est de faire tourner la logique de contrôle, traditionnellement exécutée par l’API matériel, sur un simple PC industriel durci, qui sert également de nœud Edge.

Cette approche offre une flexibilité sans précédent. Un PC Edge peut exécuter plusieurs automates logiciels en parallèle, chacun dans un environnement sécurisé, tout en hébergeant d’autres applications comme un système de vision ou un algorithme de maintenance prédictive. On passe d’un monde de boîtiers dédiés à une plateforme logicielle unifiée. La programmation peut se faire avec des langages IT standards (comme C++ ou Python) en plus des langages traditionnels (comme le Ladder), ouvrant la porte à une collaboration beaucoup plus fluide entre les équipes OT (opérationnelles) et IT (informatiques).

L’avantage est double. D’une part, on se libère de la dépendance à un fournisseur de matériel unique, ce qui réduit les coûts et facilite la maintenance. D’autre part, on gagne une agilité logicielle jusqu’ici inconnue dans le monde de l’automatisme. Déployer une nouvelle fonctionnalité ne requiert plus de changer de matériel, mais simplement de mettre à jour une application, un peu comme sur un serveur ou un smartphone.

Bien que les API matériels aient encore de beaux jours devant eux pour des tâches de sécurité critiques, la montée en puissance de l’automate logiciel sur PC Edge redessine les contours de l’architecture de contrôle industrielle vers plus d’ouverture et de modularité.

Docker en industrie : déployer une application de vision comme une app sur smartphone

L’un des plus grands défis de la convergence IT/OT est le déploiement et la maintenance des applications sur un parc hétérogène de machines. Comment s’assurer qu’un algorithme de vision par ordinateur fonctionnera de la même manière sur un PC Edge de marque A et un autre de marque B ? La réponse vient du monde de l’IT : la conteneurisation, et plus particulièrement Docker. Un conteneur est un paquet logiciel léger et autonome qui embarque une application et toutes ses dépendances (bibliothèques, code, runtime). Il s’exécute de façon identique, quel que soit l’environnement.

L’analogie la plus simple est celle de l’App Store. Avec Docker, vous pouvez « empaqueter » votre application de contrôle qualité dans un conteneur, la tester dans votre bureau, puis la déployer sur des centaines de nœuds Edge en usine en un seul clic, avec la certitude qu’elle se comportera exactement comme prévu. Les mises à jour deviennent triviales : il suffit de pousser une nouvelle version du conteneur, sans jamais toucher au système d’exploitation de la machine hôte. Cette technologie, initialement pensée pour les serveurs web, s’avère être un accélérateur formidable pour l’Industrie 4.0. Ce n’est pas un hasard si il s’agit actuellement du moteur de conteneurisation le plus utilisé.

C’est en 2013, sous l’impulsion d’un entrepreneur français, Solomon Hykes, que naît Docker. Ce produit rend plus accessible l’utilisation des conteneurs et change complètement la perception de la conteneurisation ainsi que les pratiques associées, ouvrant ainsi les possibilités d’orchestration d’architectures complexes à moindre coût.

– Inforsud Technologies, Article sur la technologie Docker

Pour un architecte réseau, cela signifie une standardisation et une simplification drastiques du déploiement. Fini les conflits de librairies ou les scripts d’installation complexes. Une application de vision, un algorithme d’IA ou une base de données locale peuvent être gérés comme des briques logicielles interchangeables, apportant une agilité et une scalabilité dignes du monde du web au cœur de l’atelier.

L’adoption de Docker en industrie n’est donc pas une simple tendance, mais un levier fondamental pour rendre le déploiement d’intelligence locale rapide, fiable et reproductible à grande échelle.

Edge Gateway : le sas de sécurité qui protège votre vieil automate des attaques externes

Connecter des machines industrielles, parfois vieilles de plusieurs décennies, au réseau IT ou à Internet est une source majeure d’inquiétude en matière de cybersécurité. Ces systèmes n’ont pas été conçus pour être exposés et sont souvent truffés de vulnérabilités. L’Edge Gateway (ou passerelle Edge) agit comme un sas de sécurité intelligent entre le monde de l’OT (Operational Technology), où tournent vos machines, et le monde de l’IT (Information Technology). Son rôle est de permettre une communication contrôlée et sécurisée, sans jamais exposer directement l’automate.

Concrètement, la passerelle se connecte d’un côté à l’automate via des protocoles industriels classiques (Modbus, Profinet, etc.) et de l’autre au réseau IT via des protocoles modernes et sécurisés (MQTT, OPC UA, HTTPS). Elle agit comme un traducteur et un pare-feu. Elle seule est autorisée à dialoguer avec le vieil automate, lisant les données dont elle a besoin et, si nécessaire, lui écrivant des commandes. Toute tentative de connexion non autorisée depuis le réseau externe est bloquée net au niveau de la passerelle. C’est le principe de la segmentation réseau, fondamental en sécurité industrielle.

Convergence IT/OT sécurisée

Une passerelle Edge ne fait pas que transmettre des données. Elle permet la convergence des technologies en agissant comme un pont. Comme le met en avant une analyse de cas d’usage par Barbara.tech, les systèmes Edge permettent de rapprocher l’IT des systèmes OT qui sont normalement isolés car moins exposés à Internet. En plaçant la capacité de calcul et de traduction au point de convergence, la passerelle facilite l’intégration sécurisée de données issues de systèmes hétérogènes, protégeant ainsi le cœur de la production.

Cette architecture permet de bénéficier des avantages de l’Industrie 4.0 (collecte de données, contrôle à distance) tout en maintenant l’intégrité et la sécurité du parc machine existant. C’est une approche pragmatique qui permet de moderniser sans tout exposer.

Ainsi, l’Edge Gateway n’est pas un simple routeur ; c’est le garde du corps de votre production, celui qui permet de connecter l’ancien et le nouveau en toute confiance.

Boucle fermée locale : corriger la dérive de soudure milliseconde par milliseconde sans passer par le serveur

La véritable puissance de l’Edge Computing se révèle dans les applications où chaque milliseconde compte. Imaginez un bras robotisé effectuant une soudure de précision. Une caméra analyse en continu la qualité du cordon de soudure. Si une dérive est détectée, il faut corriger immédiatement la trajectoire ou l’intensité du robot. Envoyer l’image au Cloud, attendre l’analyse et recevoir la commande de correction prendrait plusieurs centaines de millisecondes. C’est beaucoup trop lent : pendant ce temps, plusieurs centimètres de soudure défectueuse auraient déjà été produits.

L’Edge permet de créer une boucle de contrôle fermée et locale. La caméra envoie son flux vidéo au nœud Edge situé juste à côté. L’algorithme d’analyse s’exécute sur ce nœud et, s’il détecte une anomalie, envoie directement la commande de correction à l’automate du robot. Le cycle complet (capture, analyse, action) peut se faire en quelques millisecondes, sans jamais que la donnée n’ait à quitter l’environnement immédiat de la machine. C’est cette réactivité millimétrique qui permet de passer d’un simple contrôle qualité post-production (rejeter les pièces défectueuses) à un contrôle de processus en temps réel (éviter de produire des pièces défectueuses).

Ce principe de boucle fermée locale est la clé pour des applications de haute précision, le pilotage de systèmes autonomes ou les arrêts d’urgence. L’avantage est que cette architecture assure une faible latence et une meilleure tolérance aux interruptions réseau, un point crucial pour la continuité des opérations.

Cette autonomie locale protège les opérations et garantit une continuité même lors de coupures de réseau.

– ObjetConnecte.com, L’edge computing fait évoluer la gestion des machines

En rendant possible cette correction instantanée, l’Edge Computing ne se contente pas d’optimiser un processus ; il change la nature même de ce qui est possible en termes de qualité et de performance sur une ligne de production.

Cloud ou Edge : où traiter vos données de vibration pour une réactivité millimétrique ?

La question n’est pas de choisir l’un contre l’autre, mais de savoir où placer le curseur. Le Cloud et l’Edge forment un duo puissant, chacun excellant dans un domaine précis. La règle d’or est simple : le traitement doit se faire au plus près de l’endroit où la décision doit être prise. Le facteur temps est le principal arbitre. Comme le résume bien un expert du domaine, « les données critiques au facteur temps sont traitées en edge, tandis que les analyses longues et complexes s’effectuent dans le cloud. »

Prenons l’exemple de l’analyse vibratoire d’un moteur. Si une vibration anormale et critique est détectée, signifiant un risque de casse imminent, l’ordre d’arrêt d’urgence doit être donné en quelques millisecondes. C’est un cas d’usage parfait pour l’Edge : l’algorithme de détection tourne localement et déclenche l’action immédiatement. En revanche, l’analyse de l’historique de toutes les vibrations des six derniers mois pour construire un modèle de maintenance prédictive, identifier des tendances lentes et corréler ces données avec celles d’autres usines, est une tâche lourde qui ne requiert pas une réponse instantanée. C’est le domaine d’excellence du Cloud, avec sa puissance de calcul et sa capacité de stockage quasi illimitées.

Le tableau suivant synthétise les forces de chaque approche pour vous aider à arbitrer vos cas d’usage, comme le met en évidence une analyse comparative récente pour l’industrie.

| Critère | Edge Computing | Cloud Computing |

|---|---|---|

| Latence | Très faible (<10ms) | Variable (50-200ms+) |

| Traitement temps réel | Optimal pour contrôle process | Inadapté pour réactivité critique |

| Volume de données | Filtrage local, envoi sélectif | Stockage massif, analyses complexes |

| Continuité de service | Autonome (fonctionne hors ligne) | Dépendant de la connectivité |

| Coût bande passante | Réduit (données filtrées) | Élevé (transfert massif) |

| Cas d’usage industriel | Contrôle qualité, arrêt d’urgence | Maintenance prédictive, BI |

La meilleure architecture n’est donc pas « tout Edge » ou « tout Cloud », mais une architecture hybride où l’Edge gère l’immédiateté et la survie de la machine, tandis que le Cloud s’occupe de l’intelligence stratégique et de la vision à long terme.

Inférence locale : gagner les 200ms qui permettent d’éjecter la pièce défectueuse à la volée

L’intelligence artificielle, et notamment l’inférence (l’application d’un modèle d’IA entraîné pour faire une prédiction), est un des domaines où l’Edge Computing crée le plus de valeur. Entraîner un modèle de vision par ordinateur pour qu’il reconnaisse des défauts sur des pièces peut nécessiter la puissance de calcul massive du Cloud. Mais une fois ce modèle entraîné, l’exécuter localement sur un nœud Edge change la donne. C’est ce qu’on appelle l’inférence locale ou « IA à la périphérie ».

Sur une ligne de production à grande vitesse, une caméra filme les pièces qui défilent. Le modèle d’IA, qui tourne sur le PC Edge, analyse chaque image. S’il détecte un défaut, il déclenche un éjecteur pneumatique pour retirer la pièce de la ligne. L’aller-retour vers le Cloud pour l’analyse prendrait environ 200 millisecondes dans un cas optimal. Pendant ce temps, la pièce serait déjà loin. En effectuant l’inférence localement, on peut réduire ce temps de décision à moins de 20 millisecondes. Ce sont ces 180 millisecondes gagnées qui rendent l’éjection à la volée possible. Comme le souligne Scale Computing, cette faible latence est essentielle pour des applications en temps réel dans l’automatisation industrielle, qui dépendent d’une précision de l’ordre de la milliseconde.

Déploiement d’IA à la périphérie avec Docker

Le défi est de déployer et mettre à jour ces modèles sur des milliers d’appareils. Une étude de cas d’Ultralytics sur les villes intelligentes, parfaitement transposable à l’industrie, montre comment Docker résout ce problème. Les ingénieurs peuvent empaqueter une nouvelle version d’un modèle d’IA dans un conteneur et le déployer « over-the-air » sur tout le parc de caméras ou de nœuds Edge. Le processus est transparent et n’interrompt pas le fonctionnement des appareils, garantissant que toute la flotte bénéficie de la dernière intelligence disponible, de manière fiable et standardisée.

Le gain n’est pas seulement en vitesse, mais aussi en confidentialité et en robustesse. Les données sensibles (les images de production) ne quittent pas l’usine, et le contrôle qualité continue de fonctionner même en cas de coupure de la connexion Internet.

L’IA à la périphérie transforme ainsi l’intelligence artificielle d’un outil d’analyse a posteriori en un acteur proactif et intégré au cœur même du processus de production.

À retenir

- Filtrer avant d’envoyer : La première mission de l’Edge est de réduire le « bruit » des données pour n’envoyer que les informations utiles au Cloud, optimisant bande passante et coûts.

- Edge pour l’action, Cloud pour l’analyse : Utilisez l’Edge pour tout ce qui demande une réactivité en millisecondes (contrôle, sécurité) et le Cloud pour les analyses lourdes et à long terme (maintenance prédictive, BI).

- Moderniser sans remplacer : L’Edge Computing, via les passerelles et la conteneurisation, permet de « greffer » de l’intelligence sur votre parc machine existant de manière sécurisée et progressive.

Comment passer à l’Industrie 4.0 sans remplacer tout votre parc machine existant ?

La perspective de l’Industrie 4.0 peut sembler intimidante, évoquant des projets de remplacement complets d’usines (« greenfield »). Heureusement, une approche beaucoup plus pragmatique et rentable existe : la modernisation de l’existant, ou approche « brownfield ». L’Edge Computing est le principal catalyseur de cette stratégie. Il permet de construire des ponts technologiques pour connecter, sécuriser et extraire de la valeur de votre parc actuel, machine par machine, ligne par ligne. Il ne s’agit pas d’un grand soir technologique, mais d’une évolution itérative et maîtrisée.

Cette démarche progressive permet de cibler en priorité les cas d’usage à plus fort retour sur investissement, de faire ses preuves avec des projets pilotes, et de monter en compétence sans paralyser la production. Le marché ne s’y trompe pas, et la dynamique est forte, avec une croissance annuelle de plus de 30% attendue pour le secteur de l’Edge Computing entre 2021 et 2028. La question n’est plus « faut-il y aller ? » mais « par où commencer ? ».

Le plan d’action suivant, inspiré des meilleures pratiques du secteur, propose une feuille de route claire pour initier cette transition en douceur.

Votre plan d’action pour une modernisation « Brownfield »

- Déployer des passerelles Edge : Commencez par installer des Edge Gateways pour convertir les protocoles, filtrer les données à la source et effectuer une première analyse avant de transmettre les informations pertinentes aux systèmes centraux.

- Segmenter les réseaux : Mettez en œuvre une séparation physique et logique entre vos réseaux OT (production) et IT (informatique) pour permettre un flux de données contrôlé et sécuriser vos équipements les plus anciens.

- Lancer des projets pilotes ciblés : Identifiez un ou deux cas d’usage à forte valeur ajoutée (ex: monitoring d’une machine critique, contrôle qualité sur une ligne) pour démontrer un retour sur investissement clair et obtenir l’adhésion en interne.

- Utiliser des plateformes modulaires : Adoptez des plateformes d’intégration qui vous permettent de prioriser les systèmes critiques tout en planifiant une feuille de route pour une implémentation plus large à l’avenir.

Pour mettre en pratique ces conseils, l’étape suivante consiste à identifier un cas d’usage pilote sur votre parc machine actuel et à évaluer la solution Edge la plus adaptée pour le concrétiser. C’est en commençant petit et en mesurant les résultats que vous transformerez progressivement votre usine en un environnement véritablement flexible et intelligent.