Le vrai choix n’est pas entre un API et un PC industriel, mais dans la définition d’une architecture de contrôle qui prévient la dette technique et garantit la maintenabilité.

- La structure du code et la gestion des Entrées/Sorties ont plus d’impact sur le coût total de possession (TCO) que le matériel lui-même.

- Les PC industriels, couplés à un OS temps réel, offrent une alternative viable aux API traditionnels pour la convergence IT/OT.

Recommandation : Auditez vos besoins en déterminisme, sécurité et communication avant de sélectionner une plateforme matérielle.

En tant que chef de projet automatisme, le dilemme entre l’Automate Programmable Industriel (API) et le PC Industriel (IPC) pour piloter une nouvelle machine est un classique. La discussion s’oriente souvent vers une comparaison binaire : la robustesse éprouvée de l’API face à la flexibilité et la puissance de calcul de l’IPC. Cette vision, bien que correcte en surface, masque une réalité plus complexe et stratégique. Le débat a évolué, et se cantonner à cette opposition, c’est risquer de prendre une décision basée sur des critères dépassés.

Le véritable enjeu n’est plus simplement de choisir une « boîte », mais de concevoir une architecture de contrôle complète. Cette architecture doit garantir non seulement la performance et la fiabilité, mais aussi la maintenabilité à long terme, l’évolutivité et, au final, un coût total de possession (TCO) maîtrisé. Ignorer ces aspects revient à créer une machine potentiellement performante au jour J, mais qui se transformera en un casse-tête technique et financier au premier dépannage ou à la première demande d’évolution.

La question n’est donc pas « API ou IPC ? », mais « Quelle architecture de contrôle pour centraliser l’intelligence de ma machine de manière robuste et pérenne ? ». Cet article propose de dépasser le simple comparatif matériel pour vous fournir une grille de lecture structurelle. Nous aborderons les décisions critiques, de la structuration logicielle à l’architecture réseau, qui définissent réellement la viabilité de votre système d’automatisme.

Pour vous guider dans cette réflexion stratégique, nous allons examiner les huit piliers architecturaux qui doivent orienter votre choix. Chaque section abordera une problématique concrète, vous donnant les clés pour construire un système de contrôle à la fois performant et durable.

Sommaire : Architecturer le contrôle machine : au-delà du choix API vs. IPC

- Pourquoi le code « spaghetti » rend votre machine impossible à dépanner par un tiers ?

- Cartes E/S locales ou déportées : comment réduire le câblage de 40% dans la machine ?

- Automate de sécurité (Safety) : intégrer ou séparer la fonction sécurité du process standard ?

- Ladder, ST ou Grafcet : quel langage pour quelle fonction de la machine ?

- Mise à jour firmware : l’erreur de version qui plante la communication avec les variateurs

- Profinet ou EtherNet/IP : quel standard privilégier pour une architecture Siemens/Rockwell mixte ?

- Automate logiciel sur PC Edge : la fin des automates matériels propriétaires ?

- Pourquoi Windows n’est pas suffisant pour piloter une machine rapide (et ce qu’il faut utiliser) ?

Pourquoi le code « spaghetti » rend votre machine impossible à dépanner par un tiers ?

La première décision architecturale n’est pas matérielle, mais logicielle. Un code non structuré, souvent qualifié de « code spaghetti », est une bombe à retardement pour la maintenance. Il se caractérise par une logique enchevêtrée, des sauts de programme imprévisibles et une absence de modularité. Au-delà de l’aspect inesthétique, son principal défaut est de rendre le programme illisible et donc indéchiffrable pour quiconque n’est pas son auteur original. Lors d’un arrêt de production, chaque minute compte. Un technicien de maintenance, même expérimenté, perdra un temps précieux à simplement tenter de comprendre le flux d’exécution avant de pouvoir poser un diagnostic.

Ce chaos logiciel constitue ce que l’on appelle la dette technique. Chaque raccourci pris lors du développement pour gagner du temps se paie au centuple en coûts de maintenance et en temps d’arrêt. C’est un coût caché qui grève lourdement le TCO de la machine. L’impact est bien réel : une analyse de McKinsey a montré une corrélation directe entre la qualité du code et la performance financière. Les entreprises qui gèrent le mieux leur dette technique peuvent atteindre jusqu’à 20% de croissance de revenus supplémentaire.

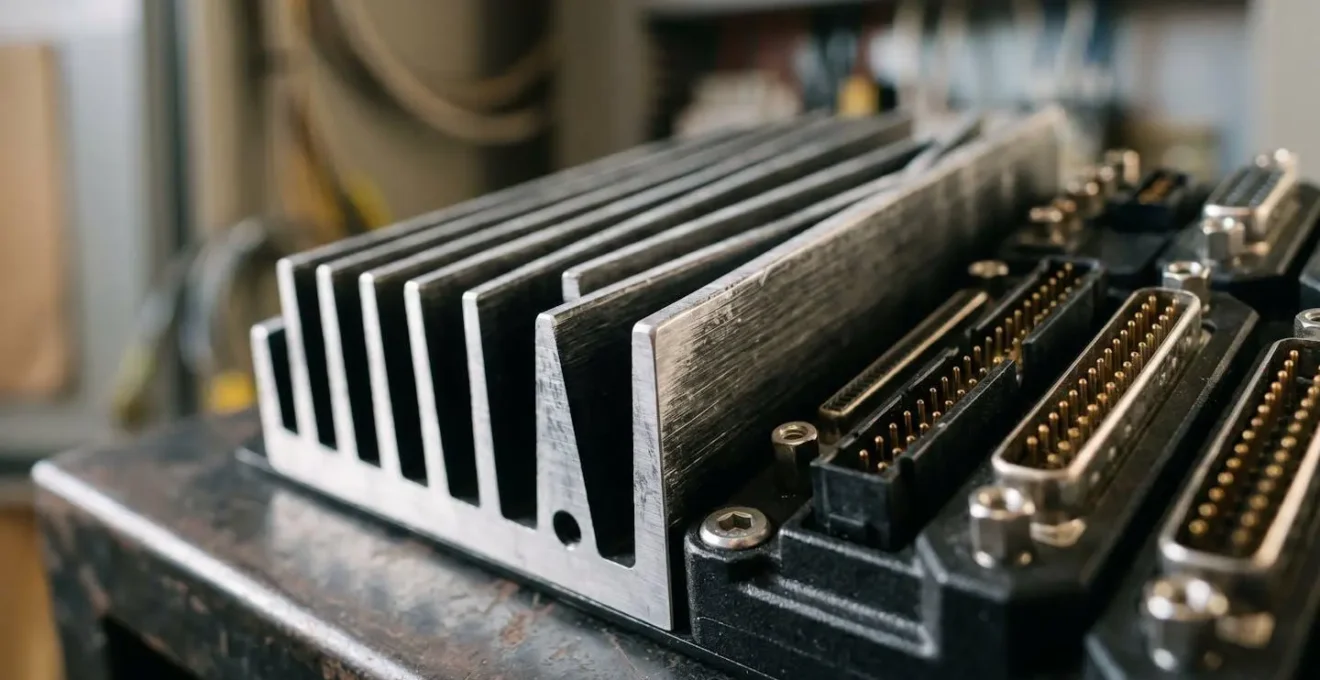

L’illustration ci-dessous est une métaphore visuelle de cette complexité. L’enchevêtrement des câbles représente parfaitement le chaos d’un programme mal structuré, où suivre une seule information devient une tâche herculéenne.

Choisir une plateforme (API ou IPC) doit donc s’accompagner d’une méthodologie de programmation rigoureuse. L’adoption de standards comme la programmation orientée objet, l’encapsulation de fonctions dans des blocs réutilisables ou l’utilisation de machines à états claires (via Grafcet/SFC par exemple) n’est pas une option. C’est un prérequis pour garantir que votre machine puisse être dépannée, maintenue et améliorée efficacement par n’importe quelle équipe compétente, protégeant ainsi votre investissement sur le long terme.

Cartes E/S locales ou déportées : comment réduire le câblage de 40% dans la machine ?

Après le logiciel, l’architecture physique du contrôle est le deuxième pilier. La question de la centralisation ou de la décentralisation des Entrées/Sorties (E/S) a un impact direct sur le coût de conception, d’installation et de maintenance de la machine. L’approche traditionnelle consiste à ramener tous les signaux des capteurs et actionneurs vers une armoire électrique centrale où se trouvent l’automate et ses cartes d’E/S locales. Si cette méthode est simple à concevoir, elle génère des kilomètres de câbles, des armoires volumineuses et un temps de câblage et de test considérable.

L’alternative est l’architecture distribuée, ou E/S déportées. Le principe est de placer de petits modules d’E/S au plus près des capteurs et actionneurs sur la machine. Ces modules sont ensuite connectés à l’unité de contrôle centrale (API ou IPC) via un unique câble de bus de terrain (comme Profinet, EtherNet/IP ou EtherCAT). Cette approche transforme radicalement la conception de la machine. Selon les experts du domaine, les systèmes d’E/S déportées permettent une réduction significative des efforts de câblage, entraînant des économies substantielles en termes de matériel, de main-d’œuvre et de temps de mise en service.

L’adoption de bus de terrain ouverts a été un levier majeur de cette transformation. Le Profibus, par exemple, a été l’un des premiers standards à éliminer le câblage point-à-point complexe. Avec plus de 15 millions de nœuds installés, il a démontré à grande échelle les bénéfices d’une architecture distribuée, réduisant la complexité de conception et d’installation. Cette philosophie est aujourd’hui portée par les réseaux Ethernet industriels qui offrent en plus des débits et des fonctionnalités de diagnostic avancées. Le choix entre E/S locales et déportées n’est donc pas anodin : il définit l’efficacité de l’installation et la facilité de diagnostic de votre machine.

Automate de sécurité (Safety) : intégrer ou séparer la fonction sécurité du process standard ?

La sécurité machine n’est pas une option, c’est une obligation légale et morale. La question architecturale qui se pose est de savoir comment l’intégrer. Faut-il une chaîne de sécurité « câblée », indépendante et parallèle à l’automate de process ? Ou faut-il opter pour une solution intégrée, où un automate de sécurité (Safety PLC) gère à la fois le process standard et les fonctions de sécurité (arrêts d’urgence, contrôle de portes, barrières immatérielles) sur un même bus de terrain sécurisé (ex: PROFIsafe, CIP Safety) ?

La solution séparée, bien que traditionnellement perçue comme plus simple, présente des limites. Le diagnostic est souvent opaque (un simple voyant sur un relais de sécurité) et la logique est rigide. Toute modification nécessite une réintervention dans le câblage. À l’inverse, l’approche intégrée offre une flexibilité et une transparence incomparables. Les fonctions de sécurité sont programmées, ce qui permet des scénarios complexes (ex: mode dégradé sécurisé au lieu d’un arrêt brutal). Surtout, les diagnostics sont précis et remontés directement à l’IHM, permettant à un opérateur de savoir instantanément quelle porte est ouverte ou quel arrêt d’urgence est enclenché, réduisant drastiquement les temps d’arrêt.

Le choix dépend du niveau de risque de la machine. Pour quantifier ce risque et valider la solution, la norme ISO 13849-1 définit 5 niveaux de performance (Performance Levels, ou PL), de PLa (risque faible) à PLe (risque très élevé). Un automate de sécurité intégré peut atteindre les niveaux les plus élevés (PLd, PLe) tout en offrant des avantages de coût et de flexibilité sur les machines complexes. L’intégration de la sécurité n’est donc plus un sujet de « tout ou rien ». C’est un choix d’architecture qui impacte la productivité et la maintenabilité, en transformant une contrainte réglementaire en un avantage opérationnel.

Ladder, ST ou Grafcet : quel langage pour quelle fonction de la machine ?

Le choix de la plateforme de contrôle, qu’il s’agisse d’un API ou d’un IPC, ouvre l’accès à un éventail de langages de programmation, standardisés pour la plupart par la norme IEC 61131-3. Loin d’être un simple détail technique, le choix du langage est une décision d’architecture qui doit être guidée par la nature de la tâche à accomplir et les compétences de l’équipe de maintenance. Utiliser le mauvais outil pour le mauvais travail mène inévitablement à un code complexe, inefficace et difficile à maintenir.

Chaque langage a son domaine de prédilection. Vouloir tout programmer en Ladder, par exemple, est une erreur commune qui mène au « code spaghetti ». La clé est d’adopter une approche polyglotte, en utilisant le langage le plus adapté à chaque partie du programme. Cette modularité rend le code plus lisible, plus robuste et plus facile à déboguer. Un environnement de développement moderne, qu’il tourne sur un PC d’ingénierie pour un API ou directement sur un IPC, doit permettre cette coexistence harmonieuse.

La norme IEC 61131-3 définit principalement cinq langages, chacun avec un rôle spécifique :

- SFC (Sequential Function Chart) / Grafcet : Idéal pour structurer le programme. Il décrit les séquences et les étapes du processus machine, agissant comme le « chef d’orchestre » du programme.

- LD (Ladder Diagram) : Langage graphique inspiré des schémas à relais, parfait pour la logique booléenne simple et la gestion des inter-verrouillages. Il est très apprécié des électriciens de maintenance pour sa lisibilité sur des logiques combinatoires.

- FBD (Function Block Diagram) : Approche graphique où des blocs fonctionnels sont connectés entre eux. Très efficace pour représenter des flux de données et des régulations (ex: PID).

- ST (Structured Text) : Langage textuel de haut niveau, similaire au Pascal. Il est indispensable pour les algorithmes complexes, les calculs mathématiques, les boucles et la manipulation de chaînes de caractères.

- IL (Instruction List) : Langage textuel de bas niveau, similaire à l’assembleur. Son utilisation est aujourd’hui dépréciée et il est à éviter pour les nouveaux projets.

Une architecture logicielle saine repose sur l’utilisation de ces langages en synergie : le SFC pour la structure globale, le ST pour les calculs complexes, et le LD/FBD pour les logiques d’E/S simples.

Mise à jour firmware : l’erreur de version qui plante la communication avec les variateurs

Un aspect souvent sous-estimé dans le choix d’une architecture de contrôle est la gestion du cycle de vie des composants, et plus particulièrement de leurs firmwares. Un système d’automatisme moderne n’est pas un bloc monolithique mais un écosystème d’équipements intelligents (API/IPC, variateurs de vitesse, modules d’E/S, IHM, caméras…) qui communiquent entre eux. Chaque composant possède son propre logiciel interne, ou firmware, qui évolue avec le temps pour corriger des bugs ou ajouter des fonctionnalités.

Le cauchemar de tout automaticien est la panne due à une incompatibilité de version. Remplacer un variateur de vitesse défectueux par un modèle neuf, mais doté d’un firmware plus récent, peut suffire à rompre la communication avec l’automate et paralyser toute la machine. Le diagnostic est alors complexe, car le matériel est fonctionnel, le programme est correct, mais l’ensemble ne coopère plus. Ce risque est un facteur majeur du coût total de possession (TCO), car il engendre des temps d’arrêt longs et imprévisibles.

La maintenance est une part non négligeable des coûts d’exploitation. Dans le secteur immobilier, par exemple, la maintenance représente 60% du coût d’exploitation global d’un bâtiment, un chiffre qui illustre bien l’importance de la maintenabilité dans le calcul du TCO. Une bonne architecture doit donc anticiper ces problèmes. Cela passe par le choix de constructeurs qui garantissent la compatibilité ascendante et descendante de leurs firmwares, ou qui fournissent des outils clairs pour gérer les versions. La stratégie doit inclure une documentation rigoureuse des versions de firmware installées sur chaque composant de la machine lors de sa mise en service, et un protocole strict pour toute mise à jour ou remplacement de matériel.

Profinet ou EtherNet/IP : quel standard privilégier pour une architecture Siemens/Rockwell mixte ?

Le choix du réseau de communication est le système nerveux de votre machine. À l’ère de l’industrie 4.0, les bus de terrain basés sur Ethernet se sont imposés comme le standard. Cependant, « Ethernet industriel » n’est pas un protocole unique, mais une famille de standards souvent liés à des écosystèmes de constructeurs. Les deux géants du marché sont Profinet, porté par Siemens et l’écosystème européen, et EtherNet/IP, promu par Rockwell Automation et très présent en Amérique du Nord. Choisir l’un ou l’autre n’est pas anodin, surtout dans un contexte où les composants de la machine peuvent provenir de différents fournisseurs.

Profinet est reconnu pour ses excellentes performances en temps réel, notamment pour les applications de contrôle de mouvement (motion control). EtherNet/IP, basé sur les standards CIP (Common Industrial Protocol), excelle dans l’intégration transparente des données de l’atelier (OT) vers les systèmes d’information de l’entreprise (IT). D’autres protocoles comme EtherCAT offrent des performances de synchronisation encore plus élevées pour des applications très exigeantes, tandis que Modbus-TCP reste une solution simple et universelle pour des échanges de données non critiques.

Le tableau suivant, basé sur une analyse comparative des bus de terrain, synthétise les caractéristiques clés de ces protocoles pour guider votre choix architectural.

| Protocole | Base technologique | Écosystème dominant | Application privilégiée |

|---|---|---|---|

| PROFINET | Ethernet industriel | Siemens / Europe | Automatisation process et manufacturing |

| EtherNet/IP | Ethernet industriel | Rockwell / Amérique du Nord | Contrôle discret et intégration d’information |

| EtherCAT | Ethernet temps réel | Beckhoff / Neutre | Motion control haute performance et synchronisation |

| Modbus-TCP | TCP/IP standard | Schneider / Universel | Supervision et échange de données simple |

Dans une architecture mixte, la stratégie n’est pas de choisir un camp, mais de garantir l’interopérabilité. Cela peut se faire via des passerelles ou en choisissant des composants « multi-protocoles ». Le choix d’un PC industriel peut ici offrir plus de flexibilité, car il peut souvent héberger plusieurs piles de communication logicielles simultanément. La décision doit être guidée par l’application principale (ex: motion haute vitesse -> EtherCAT) et la nécessité d’homogénéiser le parc pour simplifier la maintenance.

Automate logiciel sur PC Edge : la fin des automates matériels propriétaires ?

L’une des tendances les plus structurantes de l’automatisme est la convergence IT/OT, où le monde de l’informatique d’entreprise (IT) et celui des technologies d’exploitation (OT) fusionnent. Cette tendance se matérialise par l’émergence des « soft PLC » ou automates logiciels. Le concept est simple : au lieu d’acheter un automate matériel propriétaire, on installe un logiciel d’exécution automate sur un PC industriel (IPC), souvent un modèle compact et robuste de type « Edge ».

Cette approche change radicalement la donne. Elle permet de consolider plusieurs fonctions sur une seule machine : le contrôle temps réel de la machine, la supervision (IHM), la collecte de données, et même l’exécution d’algorithmes d’intelligence artificielle pour la maintenance prédictive. L’IPC devient une véritable plateforme de contrôle et de traitement de l’information, offrant une flexibilité et une puissance de calcul bien supérieures à celles d’un API traditionnel. On s’affranchit en partie de la dépendance à un matériel spécifique, le logiciel de contrôle pouvant potentiellement être porté sur différents types de PC.

Cette convergence est particulièrement visible dans les environnements où la donnée est reine. Le PC Edge devient la passerelle naturelle entre la machine et le cloud, collectant et pré-traitant les informations avant de les envoyer pour analyse.

Cependant, cette approche n’annonce pas la mort de l’automate matériel. Les API conservent des avantages en termes de robustesse extrême, de simplicité de mise en œuvre pour des tâches basiques et d’un écosystème de maintenance historiquement très bien implanté. Le choix d’un automate logiciel sur PC Edge est une décision d’architecture forte, pertinente pour des machines complexes, communicantes et orientées données. Il exige des compétences mixtes, à la fois en automatisme et en informatique industrielle (gestion de système d’exploitation, réseau, cybersécurité), ce qui représente le principal défi de son adoption.

À retenir

- Le choix entre API et PC industriel est avant tout une décision d’architecture système qui impacte le TCO et la maintenabilité.

- Une architecture logicielle modulaire (SFC, ST, FBD) et une gestion physique intelligente (E/S déportées) sont plus critiques que le matériel lui-même.

- La convergence IT/OT via les automates logiciels sur PC Edge offre une flexibilité inégalée, mais exige des compétences hybrides en automatisme et en informatique.

Pourquoi Windows n’est pas suffisant pour piloter une machine rapide (et ce qu’il faut utiliser) ?

Le principal argument historique contre l’utilisation d’un PC pour le contrôle machine est lié à une notion fondamentale : le déterminisme. Un système de contrôle est dit déterministe s’il peut garantir l’exécution d’une tâche dans un temps imparti et prévisible, à la microseconde près. C’est essentiel pour des applications comme le contrôle d’axe ou la sécurité machine. Or, un système d’exploitation standard comme Windows n’est absolument pas déterministe. Il est conçu pour l’usage bureautique, donnant la priorité à l’interface utilisateur. Un simple mouvement de souris ou une mise à jour en arrière-plan peut préempter le processeur et retarder l’exécution d’une tâche critique, avec des conséquences potentiellement catastrophiques pour la machine.

C’est là que les API traditionnels ont toujours excellé. Leur matériel et leur système d’exploitation sont spécifiquement conçus pour le temps réel et la robustesse, capables de résister aux vibrations et aux environnements hostiles, avec un redémarrage quasi instantané. Alors, comment un PC industriel peut-il rivaliser ? La solution ne consiste pas à utiliser Windows seul, mais à lui adjoindre une couche de temps réel. Il existe trois architectures principales pour y parvenir.

La clé est de ne jamais confier les tâches de contrôle critiques à l’OS standard. Que ce soit via un hyperviseur, une extension ou une architecture matérielle dédiée, le but est de créer une partition sanctuarisée et déterministe, isolée des aléas de Windows. Cette approche permet de combiner le meilleur des deux mondes : la robustesse du contrôle temps réel et la richesse fonctionnelle de l’environnement Windows pour l’interface homme-machine, la communication et l’analyse de données.

Votre plan d’action : auditer votre besoin en déterminisme

- Identifier les tâches critiques : Listez toutes les fonctions de la machine qui exigent une garantie temporelle (contrôle de mouvement, régulation rapide, synchronisation d’axes, fonctions de sécurité).

- Quantifier la contrainte temporelle : Pour chaque tâche critique, définissez le temps de cycle maximum acceptable (ex: 1 ms, 500 µs). Cela déterminera la performance requise de votre noyau temps réel.

- Évaluer les flux de données : Cartographiez les échanges d’informations entre les fonctions temps réel et les applications non temps réel (ex: remonter des données de production à l’IHM).

- Analyser les compétences internes : Évaluez la capacité de vos équipes de maintenance à diagnostiquer un système basé sur un OS temps réel (RTOS) ou un hyperviseur.

- Comparer les architectures : Sur la base des points précédents, comparez la pertinence d’une solution API, d’un PC avec extension temps réel (RTX64, TwinCAT) ou d’un PC avec hyperviseur.

Pour garantir la pérennité et la performance de votre machine, l’étape suivante consiste à formaliser ces choix dans un cahier des charges d’architecture de contrôle détaillé.