Le véritable échec de la vision 2D face à la variabilité n’est pas son manque de profondeur, mais son incapacité à quantifier le désordre d’un environnement de production réel.

- Les facteurs environnementaux (lumière, reflets) et la disposition des pièces (empilement, occlusion) créent un chaos que seule une modélisation 3D peut interpréter.

- Le passage à la 3D est une mutation stratégique qui consiste à mesurer et gérer l’imprévu, plutôt que de chercher à l’éliminer par des contraintes mécaniques coûteuses.

Recommandation : Adoptez le guidage 3D pour transformer la variabilité de votre production d’un problème ingérable en une série de données exploitables par le robot.

Pour un ingénieur méthodes, le scénario est familier : la cellule robotisée s’arrête. La cause ? Une pièce légèrement déplacée, une inclinaison imprévue, un reflet parasite. Le système de vision 2D, pourtant si fiable sur le papier, est aveugle à cette simple déviation du monde parfait pour lequel il a été programmé. La réponse habituelle consiste à renforcer les contraintes : des centreurs plus précis, des gabarits plus stricts, un éclairage plus contrôlé. On tente de forcer la réalité à se conformer au modèle plat et rigide de la caméra 2D.

Cette approche est une impasse. Elle lutte contre un symptôme en ignorant la cause fondamentale : l’environnement de production est, par nature, variable. Les pièces ne sont jamais parfaitement positionnées, les conditions lumineuses changent, les surfaces s’usent et se salissent. La vision 2D, en se basant sur une image plate, postule un ordre qui n’existe pas. Elle ne peut pas faire la différence entre une ombre et une arête, une pièce inclinée et une pièce déformée, car il lui manque une dimension fondamentale : l’information spatiale.

Mais si la véritable clé n’était pas de contraindre l’environnement, mais de donner au robot les moyens de le comprendre dans toute sa complexité ? C’est ici que s’opère une rupture stratégique. Le passage à la vision 3D n’est pas une simple évolution technologique pour « voir en relief ». C’est un changement de paradigme : il s’agit d’arrêter de lutter contre le désordre et de commencer à le quantifier. La 3D ne se contente pas de voir une pièce ; elle modélise sa position, son orientation et son environnement immédiat, transformant l’imprévu en un nuage de points exploitable.

Cet article propose une analyse dimensionnelle des situations où la 2D atteint ses limites et où la 3D devient la seule réponse viable. Nous allons disséquer les défis techniques concrets, des surfaces brillantes aux pièces empilées, pour comprendre non pas « si » il faut passer à la 3D, mais « pourquoi » c’est devenu indispensable pour quiconque cherche à construire une automatisation véritablement robuste et adaptable.

Pour naviguer à travers cette analyse dimensionnelle, voici les points critiques que nous allons explorer. Chaque section aborde un défi spécifique où la perception de la profondeur et la modélisation 3D offrent des solutions que la vision 2D ne peut tout simplement pas fournir.

Sommaire : Guidage robotique 3D : une analyse dimensionnelle des défis de la production

- Lumière structurée ou triangulation laser : quelle technique pour des pièces métalliques brillantes ?

- La mire de calibration : l’outil indispensable que l’on perd toujours (et comment s’en passer)

- Nuage de points : quand trop de résolution tue le temps de cycle du robot ?

- Lumière du soleil : comment empêcher les fenêtres de l’atelier de perturber votre caméra 3D ?

- Reconnaissance de forme 3D : comment distinguer deux pièces similaires empilées l’une sur l’autre ?

- Vision traditionnelle vs Deep Learning : quand l’IA devient indispensable pour les défauts variables

- Caméra fixe ou embarquée sur le bras : quel choix pour ne pas ralentir le SCARA ?

- Bin-picking (Dévracage) : pourquoi est-ce si difficile d’atteindre 99% de réussite de prise ?

Lumière structurée ou triangulation laser : quelle technique pour des pièces métalliques brillantes ?

Le premier défi dimensionnel auquel un système de vision 3D est confronté est la nature même de la surface à analyser. Les technologies 3D actives, comme la lumière structurée et la triangulation laser, fonctionnent en projetant un motif lumineux et en analysant sa déformation. La triangulation laser projette une ligne ou un point, tandis que la lumière structurée projette un motif complexe (pattern). Dans les deux cas, la caméra doit pouvoir « voir » ce motif clairement. C’est là que les pièces métalliques brillantes introduisent une première forme de chaos : la réflexion spéculaire.

Contrairement aux surfaces mates qui diffusent la lumière dans toutes les directions, une surface métallique polie agit comme un miroir. Le faisceau laser ou le motif lumineux n’est pas diffusé vers la caméra, mais réfléchi dans une direction précise, créant des « points chauds » aveuglants ou des zones sombres où aucune information ne revient. Le capteur reçoit alors des données erronées ou incomplètes. En effet, selon une analyse comparative, les surfaces très brillantes ou transparentes sont problématiques pour la plupart des technologies de scan 3D. Cette variabilité de la réflectivité est un problème que la vision 2D, qui se contente des contrastes de l’éclairage ambiant, ne peut même pas commencer à quantifier.

Pour contrer cet effet, la lumière structurée a souvent un avantage. En projetant un pattern sur une zone plus large et en utilisant des algorithmes d’analyse d’image sophistiqués, elle peut mieux filtrer les réflexions parasites et reconstruire la forme à partir des zones où le motif reste visible. Des techniques comme l’utilisation de plusieurs expositions (HDR) ou de filtres polarisants peuvent également être employées. Le choix technologique dépend donc de la capacité du système à modéliser non seulement la géométrie de la pièce, mais aussi les propriétés optiques de sa surface, une tâche fondamentalement tridimensionnelle.

La mire de calibration : l’outil indispensable que l’on perd toujours (et comment s’en passer)

Pour qu’un système de guidage 3D soit utile, il ne suffit pas que la caméra voie en relief. Il faut qu’elle puisse communiquer la position d’un objet dans un langage que le robot comprend. Cette « traduction » s’effectue via une opération critique : la calibration. Elle permet d’établir une correspondance mathématique entre le système de coordonnées de la caméra (en pixels) et le système de coordonnées du robot (en millimètres). Traditionnellement, cette étape se fait à l’aide d’une mire de calibration, un objet physique (souvent un damier ou une plaque à pois) dont la géométrie est connue avec une très grande précision.

Le problème de la mire n’est pas technologique, il est humain et environnemental. C’est un outil qui doit être manipulé, positionné à plusieurs endroits de l’espace de travail, et qui est sujet aux chocs, à l’usure, voire à la perte. Une mire endommagée ou imprécise corrompt toute la chaîne de mesure. Chaque recalibration est une source potentielle d’erreur et un arrêt de production. En somme, la mire est une dépendance physique qui réintroduit de la rigidité et de la fragilité dans un système qui se veut flexible.

La véritable avancée dimensionnelle consiste donc à se passer de cet outil. Les systèmes modernes tendent vers des méthodes de calibration sans mire ou « auto-calibration ». Une approche consiste à fixer la caméra sur le bras du robot et à lui faire observer un point fixe dans la cellule (comme la pointe d’un outil) depuis différentes positions. En corrélant les mouvements connus du robot avec les changements de perspective de la caméra, le système peut calculer lui-même la transformation entre son propre repère et celui du robot. Une autre méthode utilise des caractéristiques naturelles et permanentes de l’environnement comme points de référence. L’objectif est de rendre la calibration intrinsèque au système, la transformant d’une procédure manuelle et faillible à un processus automatique et robuste.

Nuage de points : quand trop de résolution tue le temps de cycle du robot ?

L’un des concepts les plus puissants de la vision 3D est le nuage de points. C’est la représentation brute de la réalité capturée par la caméra : une collection de millions de points, chacun avec ses coordonnées X, Y et Z dans l’espace. Contrairement à l’image 2D, qui est une interprétation plate, le nuage de points est un modèle géométrique direct de la scène. C’est sur cette base de données que les algorithmes vont travailler pour identifier une pièce, calculer sa position et son orientation (sa « pose »).

La tentation est grande de penser que « plus il y a de points, mieux c’est ». Une haute résolution semble garantir une meilleure précision. Cependant, cette abondance de données a un coût direct et non négligeable : le temps de traitement. Chaque point supplémentaire doit être traité, analysé, comparé à un modèle CAO. Des systèmes de vision 3D professionnels peuvent capturer et combiner une grande quantité d’informations pour construire leur modèle ; il faut parfois jusqu’à 136 images capturées pour générer les données 3D complètes d’une seule scène. Si le traitement de ce volume de données prend plusieurs secondes, il peut anéantir les gains de flexibilité en ralentissant drastiquement le temps de cycle global de la cellule.

La solution n’est donc pas dans la course à la résolution maximale, mais dans l’optimisation intelligente du rapport signal/bruit. Il s’agit de trouver la densité de points minimale requise pour garantir une reconnaissance fiable. Les stratégies pour y parvenir sont multiples :

- Le sous-échantillonnage (Downsampling) : Réduire intelligemment le nombre de points tout en préservant les caractéristiques géométriques essentielles.

- La focalisation sur les régions d’intérêt (ROI) : Ne traiter en haute résolution que la zone où la pièce est susceptible de se trouver.

- L’utilisation d’algorithmes optimisés : Privilégier des méthodes de reconnaissance qui ne nécessitent pas une comparaison point par point, mais qui extraient des « signatures » géométriques plus globales.

L’enjeu est de transformer le chaos brut du nuage de points en information pertinente le plus rapidement possible, un arbitrage constant entre la complétude des données et l’efficacité opérationnelle.

Lumière du soleil : comment empêcher les fenêtres de l’atelier de perturber votre caméra 3D ?

La vision 2D est souvent dépendante d’un éclairage contrôlé, mais la vision 3D active (lumière structurée et laser) introduit un paradoxe : elle apporte sa propre lumière, mais peut être aveuglée par celle des autres. Une source lumineuse externe et non maîtrisée est une source de variabilité majeure. Le pire coupable dans un atelier est souvent le plus anodin : une fenêtre ou une baie vitrée. La lumière du soleil est des milliers de fois plus intense que la lumière projetée par une caméra 3D. Pour le capteur de la caméra, c’est un bruit de fond colossal qui peut complètement « noyer » le signal utile.

La lumière structurée, qui projette des motifs souvent en lumière blanche ou bleue, est particulièrement vulnérable. L’infrarouge présent en masse dans la lumière solaire peut saturer le capteur CMOS, rendant le motif projeté invisible. La technologie laser, utilisant une longueur d’onde très spécifique et un filtre passe-bande sur la caméra, est généralement plus robuste. Cependant, une réflexion directe du soleil sur une pièce peut quand même créer des aberrations. Comme le souligne une analyse comparative, les scanners à lumière structurée sont bien plus sensibles aux conditions d’éclairage ambiant.

Les scanners laser sont plus adaptés à l’extérieur, tandis que la lumière structurée peut être perturbée par le soleil.

– Creadil, Guide Scanner 3D pour l’industrie

Gérer cette variabilité lumineuse est essentiel. La première solution, la plus évidente, est physique : bâcher les fenêtres, construire des carters autour de la cellule. Mais cela recrée la rigidité que l’on cherchait à éviter. Les solutions dimensionnelles sont plus intelligentes : utiliser des caméras 3D conçues pour l’extérieur, qui opèrent sur des longueurs d’onde moins affectées par le soleil (infrarouge lointain) ou qui possèdent des temps d’exposition extrêmement courts pour « figer » le motif projeté avant que la lumière ambiante ne sature le capteur. Il s’agit encore une fois de quantifier et filtrer le chaos plutôt que de l’isoler physiquement.

Plan d’action : auditer les sources de variabilité environnementale

- Points de contact lumineux : Lister toutes les sources de lumière directe et indirecte pouvant atteindre la zone de travail (fenêtres, puits de lumière, éclairage d’atelier, phares de chariots élévateurs).

- Collecte des variations : Documenter les changements d’intensité et de direction de ces sources au cours d’une journée type (soleil du matin vs après-midi, néons qui clignotent).

- Cohérence avec la technologie : Confronter ces observations aux spécifications de la caméra 3D envisagée. Est-elle sensible à la lumière ambiante ? Utilise-t-elle une longueur d’onde spécifique ?

- Analyse des surfaces : Identifier les pièces ou les zones de la cellule qui sont très brillantes ou spéculaires. Repérer où les reflets de la lumière ambiante pourraient se diriger vers la caméra.

- Plan d’intégration : Définir les actions correctrices priorisées : orientation de la cellule, ajout de filtres polarisants, choix d’une technologie laser plutôt que lumière structurée, ou carterisation partielle si inévitable.

Reconnaissance de forme 3D : comment distinguer deux pièces similaires empilées l’une sur l’autre ?

Voici un défi qui expose l’impuissance fondamentale de la vision 2D : deux pièces identiques, l’une posée sur l’autre. Pour une caméra 2D, les contours se fondent. Elle ne voit qu’une seule forme, plus grande ou difforme. Elle est incapable de comprendre le concept d’occlusion et de superposition. Pour la vision 3D, ce problème se traduit par un nuage de points continu où il n’y a pas de séparation évidente. La tâche devient alors de segmenter ce nuage en objets distincts, un processus appelé segmentation d’instance.

C’est un problème d’une grande complexité géométrique. Comment l’algorithme peut-il savoir où se termine la première pièce et où commence la seconde, surtout si elles sont parfaitement alignées ? Les méthodes traditionnelles se basent sur la détection de ruptures dans la continuité des surfaces ou sur des changements brusques de courbure. Mais lorsque les pièces sont en contact étroit, ces indices sont minimes. C’est ici que l’intelligence artificielle, et plus particulièrement le Deep Learning, offre des solutions radicalement nouvelles.

Étude de cas : la segmentation d’instances par apprentissage profond

Une thèse de recherche menée à l’Université de Lyon en collaboration avec l’entreprise Siléane a exploré cette problématique. Les chercheurs ont développé un réseau de neurones convolutionnel (FCN) entraîné spécifiquement pour une tâche : détecter les frontières entre les instances d’objets en vrac, même en cas de contact. Le réseau apprend non seulement à reconnaître la forme de l’objet, mais aussi à identifier les lignes de crête et les arêtes qui signalent une occultation. Entraîné sur des données synthétiques (modèles 3D virtuels empilés de manière aléatoire), le système a surpassé les méthodes industrielles classiques sur une maquette réelle, tout en atteignant des performances en temps réel.

Cette approche change la donne. Au lieu de programmer des règles géométriques complexes et faillibles, on entraîne un modèle à « comprendre » le concept de superposition à partir de milliers d’exemples. Le système apprend à reconnaître la signature dimensionnelle d’une pièce, même lorsqu’elle est partiellement cachée. Il peut inférer la présence d’une pièce inférieure à partir de la posture de la pièce supérieure.

Même avec une visibilité partielle, Kamido identifie et prélève vos produits en vrac, en tas ou en bacs. Quand ces produits bougent à chaque picking, la technologie Reflex permet de suivre en temps réel leurs nouvelles positions.

– Siléane, Solution Kamido de dévracage industriel

Vision traditionnelle vs Deep Learning : quand l’IA devient indispensable pour les défauts variables

La distinction entre vision 2D et 3D n’est pas la seule ligne de fracture technologique. Au sein même de la vision, une autre révolution est en marche : le passage de l’approche algorithmique traditionnelle au Deep Learning (IA). La vision traditionnelle, qu’elle soit 2D ou 3D, fonctionne sur la base de règles explicites programmées par un expert : « cherche un cercle de tel diamètre », « mesure la distance entre ces deux arêtes », « détecte un contraste supérieur à ce seuil ». Cette méthode est extrêmement efficace pour des tâches répétitives sur des objets bien définis.

Son talon d’Achille, c’est la variabilité esthétique ou non géométrique. Prenons l’exemple du contrôle qualité. Un algorithme traditionnel peut parfaitement vérifier la présence d’un trou ou mesurer un diamètre. Mais comment lui faire détecter une rayure ? Il faudrait définir ce qu’est une rayure : une ligne sombre ? De quelle longueur ? De quelle largeur ? Et si elle est courbée ? Et si c’est une tache d’huile et non une rayure ? La quantité de règles à programmer devient infinie. Le système devient fragile et génère de nombreux faux positifs ou faux négatifs.

Le Deep Learning prend le problème à l’envers. Au lieu de programmer des règles, on lui fournit des exemples. On lui montre des milliers d’images de pièces « bonnes » et des milliers d’images de pièces avec différents types de défauts (rayures, bosses, taches, corrosion, etc.). Le réseau de neurones apprend de lui-même les caractéristiques visuelles qui distinguent un défaut d’une pièce conforme. Il n’a pas besoin d’une définition de la « rayure » ; il apprend à la reconnaître de manière contextuelle. C’est la seule approche viable pour automatiser le contrôle de défauts dont l’apparence est par nature imprévisible et variable. Pour l’ingénieur, cela signifie qu’il est désormais possible d’automatiser des tâches de contrôle jusqu’ici réservées à l’œil humain, capable d’une appréciation subjective.

Caméra fixe ou embarquée sur le bras : quel choix pour ne pas ralentir le SCARA ?

Une fois la technologie 3D choisie, son intégration physique dans la cellule robotisée est une question cruciale qui a un impact direct sur la performance. Il existe deux grandes philosophies : la caméra fixe (ou « statique ») et la caméra embarquée sur le bras du robot. Le choix entre les deux est un arbitrage dimensionnel entre champ de vision, résolution, occlusion et temps de cycle, particulièrement critique pour les robots rapides comme les SCARA.

Une caméra fixe est montée au-dessus de la zone de travail.

- Avantages : Elle a une vue globale et constante de la scène, le robot ne peut pas se mettre dans son propre champ de vision, et elle n’ajoute ni poids ni inertie au bras robotisé, préservant ainsi sa vitesse et sa précision maximales. La capture d’image peut se faire pendant que le robot effectue une autre tâche, optimisant le temps de cycle.

- Inconvénients : La résolution sur la pièce diminue avec la distance. Des parties de la zone de travail peuvent être cachées par des obstacles. Si les pièces sont dans un bac profond, la caméra n’aura qu’une vue plongeante limitée.

Une caméra embarquée est montée sur la bride du robot, près du préhenseur.

- Avantages : Elle peut s’approcher très près de la cible pour obtenir un scan à très haute résolution, contourner des obstacles pour « regarder » dans un bac sous différents angles, et sa zone de travail est potentiellement illimitée.

- Inconvénients : Elle ajoute du poids et de l’inertie, ce qui peut obliger à réduire la vitesse et l’accélération du robot. Le câblage (alimentation, données) devient plus complexe et constitue un point de défaillance. Surtout, le robot doit s’arrêter pour effectuer le scan, ce qui peut créer un temps mort significatif dans le cycle.

Pour un robot SCARA, conçu pour des cycles de pick-and-place extrêmement rapides, l’ajout d’une caméra embarquée peut être contre-productif si chaque prise nécessite une pause pour le scan. Atteindre des performances élevées, avec un temps de cycle aussi bas que 10 secondes, impose souvent une architecture où la perception et l’action sont découplées. Une caméra fixe qui localise la prochaine pièce pendant que le SCARA dépose la pièce actuelle est souvent la configuration la plus efficace pour ne pas brider la vitesse inhérente à ce type de robot.

À retenir

- La vision 3D n’est pas une simple vision ‘avec profondeur’, c’est un outil de quantification du désordre inhérent à la production.

- La variabilité (pièces, lumière, position) est le véritable ennemi que la 2D ne peut combattre, car elle est conçue pour un monde parfaitement ordonné.

- Le succès en 3D repose sur un équilibre stratégique entre la richesse des données (résolution) et la rapidité d’exécution (temps de cycle).

Bin-picking (Dévracage) : pourquoi est-ce si difficile d’atteindre 99% de réussite de prise ?

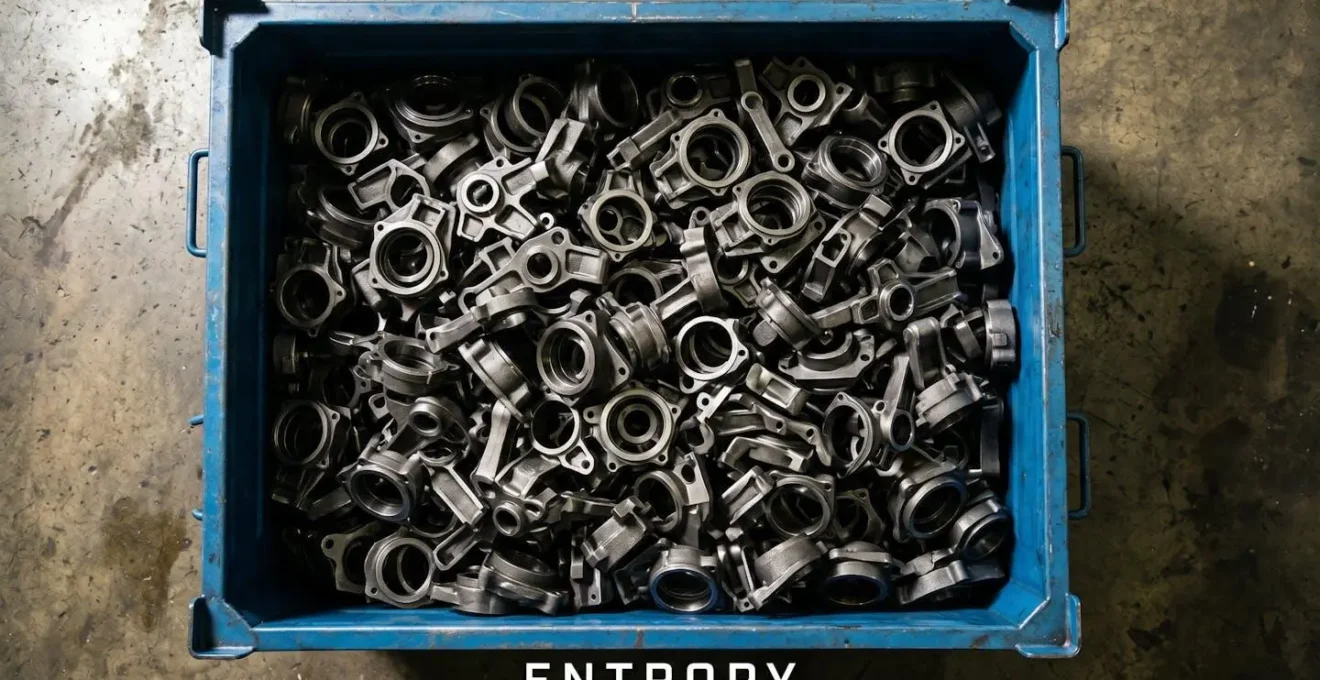

Le bin-picking, ou dévracage, est souvent considéré comme le « Saint-Graal » de l’automatisation robotisée. C’est l’application qui cristallise tous les défis dimensionnels que nous avons abordés. Il s’agit de demander à un robot de prélever des pièces disposées de manière totalement chaotique dans un bac. C’est la quintessence de la « quantification du chaos ». La vision 2D est ici totalement hors-jeu : toutes les pièces se superposent, leurs orientations sont aléatoires, et l’information de profondeur est la seule clé pour agir.

Atteindre un taux de réussite élevé est un défi immense. Une étude de cas sur une application avancée montre que même avec des systèmes optimisés, les deux cellules Ready2_BinPicking de KUKA permettent à FAVI d’atteindre des taux de rendement de 85%. Ce chiffre est excellent, mais il illustre bien la difficulté d’approcher les 100%. Le « problème du dernier pourcent » en bin-picking est exponentiellement difficile car il est constitué d’une accumulation de cas limites :

- Occlusions complexes : Des pièces parfaitement enchevêtrées ou imbriquées que l’algorithme ne peut segmenter.

- Planification de trajectoire : La pièce la plus « saisissable » n’est pas toujours accessible sans entrer en collision avec le bac ou d’autres pièces. Le robot doit trouver une trajectoire sûre.

- Singularités de préhension : Une pièce peut être identifiable, mais dans une position qui ne présente aucune surface de préhension correcte pour le gripper.

- Instabilité du vrac : Le fait de saisir une pièce peut faire bouger tout le reste du tas, rendant le nuage de points précédent instantanément obsolète.

Comme le résume une analyse de Liebherr, le dévracage est l’une des tâches les plus complexes car le robot doit identifier, prélever sans collision, orienter et transférer, le tout à partir d’une scène chaotique.

La solution à ce défi ultime combine toutes les technologies de pointe : des caméras 3D à haute vitesse, des algorithmes de segmentation d’instance basés sur l’IA, et des planificateurs de mouvement intelligents qui peuvent évaluer des milliers de trajectoires possibles en quelques millisecondes. C’est l’intégration synergique de la perception, de l’analyse et de l’action qui permet de transformer un tas de métal désordonné en un flux de production prévisible.

En définitive, abandonner la 2D pour la 3D n’est pas une simple mise à jour, mais une décision stratégique qui permet à une ligne de production de devenir véritablement résiliente face au monde réel. Pour mettre en pratique ces concepts, l’étape suivante consiste à évaluer vos propres cellules de production à l’aune de ces défis dimensionnels afin d’identifier où la quantification du chaos peut générer le plus de valeur.